通信作者:胡晓,博士,教授,主要研究方向为计算机视觉、人工智能、智能视频分析.E-mail:

作者简介:欧嘉敏,硕士研究生,主要研究方向为计算机视觉、图像处理.E-mail:1203340450@qq.com.

杨佳信,硕士研究生,主要研究方向为深度学习、显著性目标检测.E-mail:1061810048@qq.com.

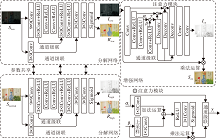

针对Retinex-Net存在噪声较大、颜色失真的问题,基于Retinex-Net的分解-增强架构,文中提出改进Retinex-Net的低光照图像增强算法.首先,设计由浅层上下采样结构组成的分解网络,将输入图像分解为反射分量与光照分量,在此过程加入去噪损失,抑制分解过程产生的噪声.然后,在增强网络中引入注意力机制模块和颜色损失,旨在增强光照分量亮度的同时减少颜色失真.最后,反射分量和增强后的光照分量融合成正常光照图像输出.实验表明,文中算法在有效提升图像亮度的同时降低增强图像噪声.

About the Author: OU Jiamin, master student. Her research interests include computer vision and image processing.

YANG Jiaxin, master student. His research interests include deep learning and salient object detection.

由于低光照环境和有限的摄像设备, 图像存在亮度较低、对比度较低、噪声较大、颜色失真等问题, 不仅会影响图像的美学、人类的视觉感受, 还会降低运用正常光照图像的高级视觉任务的性能[1, 2, 3].为了有效改善低光图像质量, 学者们提出许多低光照图像增强算法, 经历灰度变换[4, 5]、视网膜皮层理论[6, 7, 8, 9, 10, 11]和深度神经网络[12, 13, 14, 15, 16, 17, 18, 19]三个阶段.

早期, 通过直方图均衡[4, 5]、伽马校正等灰度变换方法对低亮度区域进行灰度拉抻, 可达到提高暗区亮度的目的.然而, 因为未考虑像素与其邻域像素的关系, 灰度变换常会导致增强图像缺乏真实感.

Land[6] 提出视网膜皮层理论(Retinal Cortex Theory, Retinex).该理论认为物体颜色与光照强度无关, 即物体具有颜色恒常性.基于该理论, 相继出现经典的单尺度视网膜增强算法(Single Scale Retinex, SSR)[7]和色彩恢复的多尺度视网膜增强算法(Multi-scale Retinex with Color Restoration, MSR-CR)[8].算法主要思想是利用高斯滤波器获取低光照图像的光照分量, 再通过像素间逐点操作求得反射分量作为增强结果.Wang等[9]利用亮通滤波器和对数变换平衡图像亮度和自然性, 使增强后的图像趋于自然.Fu等[10]设计用于同时估计反射和光照分量(Simultaneous Reflectance and Illumination Esti-mation, SRIE)的加权变分模型, 可有效处理暗区过度增强的问题.Guo等[11]提出仅估计光照分量的低光照图像增强算法(Low Light Image Enhancement via Illumination Map Estimation, LIME), 主要利用局部一致性和结构感知约束条件计算图像的反射分量并作为输出结果.然而, 这些基于Retinex理论模型的算法虽然可调整低光图像亮度, 但增亮程度有限.

研究者发现卷积神经网络(Convolutional Neural Network, CNN)[12]与Retinex理论结合能进一步提高增强图像的视觉效果, 自动学习图像的特征, 解决Retinex依赖手工设置参数的问题.Lore等[13]提出深度自编码自然低光图像增强算法(A Deep Auto-encoder Approach to Natural Low Light Image Enhan-cement, LLNet), 有效完成低光增强任务.Lü 等[14]

提出多边低光增强网络(Multi-branch Low-Light Enhancement Network, MBLLEN), 学习低光图像到正常光照图像的映射.Zhang等[15]结合最大信息熵和Retinex理论, 提出自监督的光照增强网络.Wei等[16]基于图像分解思想, 设计视网膜大脑皮层网络(Retinex-Net), 利用分解-增强架构调整图像亮度.Zhang等[17]基于Retinex-Net设计低光增强器.

然而, 由于噪声与光照水平有关, Retinex-Net提取反射分量后, 图像暗区噪声高于亮区.因此, Retinex-Net的增强结果存在噪声较大、颜色失真的问题, 不利于图像质量的提升.为此本文提出改进Retinex-Net的低光照图像增强算法.以Retinex-Net的分解与增强框架为基础, 针对噪声问题, 在分解网络采用浅层上下采样结构[15], 利用反射分量梯度项[15]作为损失.同时为了改善增强图像的色彩偏差, 保留丰富的细节信息, 在增强网络中嵌入注意力机制模块[18]和颜色损失[19].实验表明, 本文算法在LOL数据集和其它公开数据集上取得较优的视觉效果和客观结果.

改进Retinex-Net的低光照图像增强算法框图如图1所示.

Retinex理论[6]认为彩色图像可分解为反射分量和光照分量:

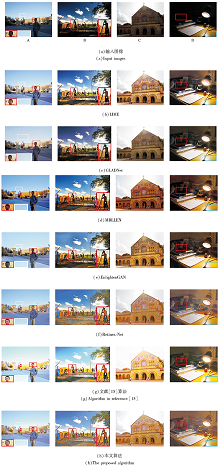

为了验证本文算法的性能及效果, 采用如下对比算法:Retinex-Net, SRIE[10], LIME[11], MBLLEN[14]、文献[15]算法、全局光照感知和细节保持网络(Global Illumination-Aware and Detail-Preserving Net-work, GLADNet)[24]、无成对监督深度亮度增强(Deep Light Enhancement without Paired Supervision, EnlightenGAN)[25].在实验过程中, 均采用原文献提供的模型或源代码对图像进行测试.

采用如下客观评估指标:峰值信噪比(Peak Signal to Noise Ratio, PSNR)、结构相似性(Structural Similarity, SSIM)[26]、自然图像质量评估(Natural Quality Evaluator, NIQE)[27]、通用图像质量评估(Universal Quality Index, UQI)[28]、基于感知的图像质量评估(Perception-Based Image Quality Evaluator, PIQE)[29].SSIM、PSNR、UQI值越高, 表示增强结果图质量越优.相反, PIQE、NIQE值越高, 表示图像质量越差.

为了进一步验证本文算法各模块的有效性, 以Retinex-Net为基础设计消融性实验, 利用PSNR衡量噪声水平, 采用SSIM从亮度、对比度、结构评估图像综合质量.实验结果如表1所示, 表中S-ULS表示浅层上下采样结构, ld表示去噪损失.Enhan_Ilow表示增强网络输入仅为光照分量, AMM表示注意力机制模块, Lc表示颜色损失.参数微调1表示增强网络的平滑损失系数由原Retinex-Net的3设为1; 参数微调2是增强网络的平滑损失系数为1, 批量化大小由16设为32.

| 表1 各改进模块及损失的消融性实验结果 Table 1 Ablation experiment results of improved modules and loss |

表1中序号2给出以Retinex-Net为基础, 采用浅层上下采样结构作为分解网络的结果.相比Retinex-Net, PSNR值显著提高, 表明此结构可抑制由图像分解带来的噪声.在此基础上添加去噪损失, 进一步降低噪声, 见序号3.由此验证浅层上下采样结构与去噪损失的有效性.

在本文算法中, 由于采用两步训练的方式, 即先训练分解网络后训练增强网络, 因此在验证浅层上下采样结构和去噪损失的有效性后, 以此为基础评估增强网络引入的注意力机制模块和颜色损失的有效性.在Retinex-Net中增强网络的输入为反射分量与光照分量通道级联后的结果.该设置一定程度上会导致反射分量丢失图像结构和细节, 同时影响光照分量的亮度提升.为此, 先设置序号4的实验验证上述分析.由结果可见:PSNR、SSIM值大幅提高, 证明此分析的正确性, 表明本文算法的增强网络仅以光照分量作为输入的有效性.

另外, 从序号5结果看出, 利用注意力模块后, 图像噪声显著降低, 这归功于注意力模块可减少对图像无关特征的响应, 集中注意力学习亮度特征, 从而降低图像噪声水平.在颜色损失的消融性实验中, 尽管客观数值上没有直观体现颜色的恢复, 但根据图2和图3可知, 该损失是有效的.为了使各模块更好地发挥优势, 本文算法对参数进行微调.从序号7、序号8的实验结果可见, 微调参数后本文算法各模块作用进一步体现, 取得更优结果.

各算法在3个数据集上的客观评估结果如表2所示, 表中黑体数字表示最优结果, 斜体数字表示次优结果.

在LOL数据集上, SSIM可从亮度、对比度、结构度量2幅图像相似度, 与人类视觉系统(Human Vision System, HVS)具有较高相关性[21, 30], 可较全面体现图像质量.

从表2可见, 在SSIM、UQI指标上, 本文算法取得最高数值, 表明低光照图像经本文算法增强后图像质量得到明显提升.从图2和图3发现, 本文算法也提升视觉效果的表现力.

由表2的LOL数据集上结果可知, 在PSNR指标上, 本文算法总体上优于先进算法.根据文献[21]、文献[30]和文献[31]的研究, PSNR指标因为容易计算, 被广泛用于评估图像, 但其计算是基于误差敏感度, 在评估中常出现与人类感知系统不一致的现象, 因此与图像主观效果结合分析能更好地体现图像质量.结合图2和图3的分析, GLADNet的增强图像饱和度较低, 存在颜色失真现象.文献[15]算法使图像过曝光.本文算法在Retinex-Net基础上显著降低图像噪声, 保留图像丰富结构信息, 相比其它方法, 视觉效果更佳, 符合人类的视觉感知系统.

| 表2 各算法在3个数据集上的客观评估结果 Table 2 Objective evaluation results of different algorithms on 3 datasets |

在LOL数据集上, 对比大部分算法, 本文取得与参考图像相近的NIQE数值, 表明本文算法的增强结果更接近参考图像.

DICM、MEF数据集没有正常光照图作为参照.本文只采用盲图像质量评估指标(NIQE、PIQE)评估各算法.在PIQE指标上, 本文算法取得最优值.对于NIQE, 虽然未取得较好优势, 但相比Retinex-Net, 本文算法取得更好的增强结果.

综上所述, 虽然本文算法未在所有指标上取得最优结果, 但仍有较高优势.在与人类视觉感知系统有较好相关性的SSIM指标及噪声抑制和避免过曝能力上, 本文算法最优.

由图2可见, SRIE、LIME、EnlightenGAN的增亮程度有限, 增强结果偏暗.GLADNet、MBLLEN改变图像饱和度, 降低图像视觉效果.相比Retinex-Net, 本文算法的增强结果图噪声水平较低, 可保持图像原有的色彩.

由图3可见, SRIE增强程度远不足人类视觉需求, 在图3的图像A中, 未展示其增强结果.在图3中, 根据人眼视觉系统, 首先能判断LIME、GLADNet、MBLLEN、EnlightenGAN对人脸的增亮程度仍不足, GLADNet、MBLLEN分别存在饱和度过低和过高现象.而文献[15]算法、Retinex-Net、本文算法能较好观察到人脸细节, 但同时从左下角细节图可见, Retinex-Net人脸的边缘轮廓对比度过强.从颜色上进一步分析可知, 文献[15]算法亮度过度增强, 导致图像颜色失真, 如天空的颜色对比输入图像色调偏白、曝光难以观察远处的景物等.

同样观察图3中图像B右下角细节, 经过分析可得, 文献[15]算法、Retinex-Net、本文算法增强程度满足人类视觉需求, 但文献[15]算法过曝光, 从Retinex-Net细节图可见人物服饰失真.对比其它算法, 本文算法结果的亮度适中, 图像具有丰富细节, 避免光照伪影与过曝光现象.

另外, 从图3中图像C、D可见, LIME、GLAD-Net、MBLLEN、EnlightenGAN没能较好处理局部暗区, 如笔记本、右下角拱门窗户区域仍未增亮, 导致难以识别边缘细节.而文献[15]算法饱和度发生变化.Retinex-Net存在伪影和噪声等问题.本文算法不仅可增强图像的亮度, 减小噪声, 还保留图像的细节, 图像效果更有利于高级视觉系统的识别或检测.

综合上述分析发现, 本文算法对低光照图像增强效果更优.

针对Retinex-Net噪声较大、颜色失真问题, 本文提出改进Retinex-Net的低光照图像增强算法.算法在分解网络采用浅层上下采样结构及去噪损失, 在增强网络嵌入注意力机制模块和颜色损失.实验表明, 本文算法不仅能增强图像亮度, 而且能显著降低噪声, 并取得较优结果.本文算法较好地处理亮度增强过程中无法避免的噪声问题, 兼顾提升亮度和降低噪声任务, 可给未来研究图像多属性增强提供思路, 如低光增强、去噪、颜色恢复、去模糊等多任务同步进行.今后研究重心将是实现图像多属性同步增强.同时扩展该研究网络结构到其它高级视觉任务中, 作为图像预处理模块, 期望实现网络的端到端训练.

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|

| [13] |

|

| [14] |

|

| [15] |

|

| [16] |

|

| [17] |

|

| [18] |

|

| [19] |

|

| [20] |

|

| [21] |

|

| [22] |

|

| [23] |

|

| [24] |

|

| [25] |

|

| [26] |

|

| [27] |

|

| [28] |

|

| [29] |

|

| [30] |

|

| [31] |

|