宋传鸣,博士,教授,主要研究方向为图像及视频编码、交通视频处理.E-mail:chmsong@lnnu.edu.cn.

刘 丹,硕士,副教授,主要研究方向为图像及视频编码.E-mail:liudan_dl@163.com.

作者简介:

刘定坤,硕士,主要研究方向为屏幕视频编码、视频信息处理.E-mail:759192620@qq.com.

孙诗琦,硕士研究生,主要研究方向为屏幕视频编码、运动估计技术.E-mail:506301374@qq.com.

由于边缘反走样区域的相邻索引不具备等值关系,调色板编码的预测效率有限,因此文中提出基于边缘反走样决策和多方向模板的自适应预测编码方法.引进Pitteway面积加权的边缘反走样决策,设计8个4-邻域方向预测模板.利用2D线性相关模型建模待预测索引与4个参考像素之间的相关性.采用最小二乘法为每个方向模板计算一组预测权重系数,自适应地学习显示适配器的边缘反走样算法,实现索引图预测编码.实验表明,文中方法预测准确率较高,能够增强调色板编码在边缘反走样区域和复杂边缘区域的自适应预测能力.

SONG Chuanming, Ph.D., professor. His research inte-rests include image and video coding, and traffic surveillance video processing.

LIU Dan, master, associate professor. Her research interests include image and video coding.

AboutAuthor:

LIU Dingkun, master. Her research inte-rests include screen content video coding and video information processing.

SUN Shiqi, master student. Her research interests include screen content video coding and motion estimation techniques.

The prediction ability of the palette coding is limited in the edge anti-aliasing regions, since the adjacent indexes do not present equivalence relation. Therefore, an adaptive predictive coding method is proposed based on edge anti-aliasing decision and multiple directional templates. Eight 4-neighbor directional prediction templates are firstly designed by introducing the Pitteway anti-aliasing decision with area weight. Subsequently, a two-dimensional linear correlation model is exploited to describe the relationship between the index to be predicted and its four reference pixels. Finally, the least square method is applied to calculate a group of weight coefficients for each directional template. The anti-aliasing algorithm executed by the display adapter is adaptively learned, and thus the predictive coding of the index map is realized. Experiments show that the proposed method achieves a higher prediction accuracy and the adaptive prediction ability of the palette coding in the anti-aliasing regions and complex edge regions is improved.

本文责任编委 黄华

Recommended by Associate Editor HUANG Hua

桌面云、无线显示和云游戏等应用均要求把计算机屏幕的显示内容通过网络链路传输到远程客户端, 实现屏幕协同共享.8K、10K超高清屏幕和3D虚拟现实也需在设备之间以视频方式低延时地传输显示流[1, 2, 3].因此, 屏幕内容编码(Screen Content Co-ding, SCC)是降低网络或串行总线带宽的必需环节.由于屏幕内容的数据分布特性与自然视频明显不同[4], 面向自然视频的编码方法无法为屏幕内容提供令人满意的压缩效率, 于是, H.265/HEVC及新一代通用编码标准H.266/VVC(Versatile Video Coding)都将SCC作为重要的目标应用之一, 并围绕其高效率编码展开深入研究[5, 6, 7].

自H.265/HEVC编码标准制定以来, 研究人员为保证不连续色调区域的主观保真度, 大致提出6类无损或近无损的屏幕内容编码方法[4]:基于调色板的编码算法[8]、基于模板匹配的编码算法[9]、基于块匹配的编码算法[10]、基于字典的编码算法[11]、基于形状表示的编码算法、基于方向预测的编码算法[12].

基于块匹配的编码和基于调色板的编码算法是促使HEVC-SCC和H.266/VVC产生性能增益的主要手段[13, 14].尽管传统视频编码的运动估计为基于块匹配的编码算法提供较好参考, 技术方法较成熟, 但很难使用固定形状的像素集合实现对文本、图表和图标等内容的最佳预测, 计算量较大.基于调色板的编码算法的计算量明显低于帧内块拷贝, 能充分发掘屏幕内容的颜色数量较少、重复图案和细腻线条较多的特点, 较好地满足屏幕内容编码对压缩效率、实时性和复杂性的需求, 成为HEVC-SCC和H.266/VVC的重要空间域编码技术.

索引图是基于调色板的编码算法中数据量最大的一部分, 预测编码效率直接影响该类算法的整体压缩性能[15, 16, 17].依据发掘的数据冗余划分, 现有的索引图编码方法主要有4类:算术编码、词典编码、行程编码、预测编码.算术编码未充分发掘索引图的局部/非局部数据相关性, 编码效率不高, 而且较长的索引串往往会降低词典编码的效率[18], 增加访存代价.Zhou等[11]引进主参考缓冲区和辅助参考缓冲区, 提出通用编码算法, 但时空复杂度较高.为此, HEVC-SCC和H.266/VVC标准目前主要采用行程编码和预测编码策略对索引图进行压缩.

行程编码主要发掘索引值的局部相关性, 实现压缩.Ma等[19]将索引值组织成一系列2元、3元组序列进行编码, 但无法充分降低2D数据冗余.Xu等[20]提出索引图的2D行程编码方法.Pu等[17]和方诚等[21]进一步发现在相邻行(列)之间存在较强的局部相关性, 并提出若一个图像块的某行(列)与其相邻行(列)有相同的索引值, 使用垂直(水平)行程模式编码该行(列)像素的索引图.虽然此方法对规则区域和平滑区域的索引图有效, 但在边缘和纹理较复杂区域的编码效率偏低.Zhu等[22]结合行程编码与帧内块匹配技术, 提出混合编码方法, 但仅考虑列方向的相关性, 尚不够充分发掘局部相关性.Tsang等[23]和Badry等[24]通过率失真函数在行程编码与帧内块拷贝之间进行决策.Kuang等[10]利用卷积神经网络在行程编码、帧内块拷贝和帧内预测之间优化选择.虽然这两种方法节省模式选择时间, 但需增加2%以上的边信息代价.

相比之下, 预测编码可兼顾降低索引图的局部和非局部冗余以完成编码, 实现编/解码端的自同步, 无需附加边信息.Zhu等[15, 25]提出多级预测编码方法(Multi-stage Prediction, MSP), 通过方向预测去除索引值的局部相关性, 采用模板匹配发掘非局部数据冗余, 平均预测准确率达到92%.类似地, Pan等[26]提出两级层次预测编码模式.Strutz等[9]认为在模板匹配过程中应适当考虑设备噪声对像素值的影响, 设计基于误差软阈值的6-邻域模板匹配方案和四阶段预测编码方法.

然而, 上述三种方法均涉及多轮扫描, 计算量较大.Zhu等[27]发掘不同块间的索引相关性, 利用已编码块的索引值预测当前待编码块, 对规则区域较有效, 但无法实现方向预测.陈规胜等[8]发现索引图常表现明显的方向相关性, 提出二次方向预测方法(Twice Directional Prediction, TDP), 预测准确率达到95.48%.宋传鸣等[28]进一步利用索引值的优化分配和预测过程的双向反馈, 预测精度提高到96.32%.然而, 尚有约3.68%的索引值不能借助局部方向相关性得到有效处理, 这些预测失败的索引大多分布在边缘的过渡或连接区域.为此, Sun等[14, 29]引进颜色转移表, 描述2个相邻索引值之间的状态转移关系.由于仅考虑水平方向的1D颜色过渡, 对反走样区域中复杂边缘周围的索引值预测效率仍显不足.宋传鸣等[30]采用2D马尔可夫过程刻画边缘过渡区的颜色渐变, 利用2-邻域匹配模板预测沿着± 45° 、± 135° 方向的特定颜色转移模式[31] , 取得一定效果.

综上所述, 虽然现有的索引图预测方法在大部分区域取得较高的编码效率, 但对于那些分布在边缘过渡区或连接区的索引值, 方向预测能力仍较差.主要原因在于:1)现有方法均利用单一模板完成预测, 不具备较好的方向自适应能力; 2)现有预测方法常依赖于相邻像素间的等值关系, 而屏幕内容会开启边缘反走样处理以缓解细腻线条和锐利边缘周围的锯齿效应, 使文字、线条的边缘连接区域的索引值常在反走样作用下呈现更复杂的方向分布模式, 破坏这些模板依赖的等值关系, 影响现有的行程编码和预测编码的效率.况且, 鲜有研究人员专门针对索引图中存在边缘反走样的过渡或连接区域的索引值预测方法展开研究.在这种情况下, 本文从反走样原理出发, 采用更灵活多样的方向模板和2D线性自相关系数建模边缘过渡区或连接区的索引值渐变, 提出基于边缘反走样决策和多方向模板的自适应预测编码方法.首先, 将0° ~180° 方向区间均匀划分为8个子区间, 借鉴Pitteway等[32]提出的边缘反走样算法思想, 设计8个大小为4× 4的方向模板, 从而根据待预测像素的边缘分布方向, 自适应地为其选取4个因果预测像素.然后, 根据待预测像素沿边缘方向的相关性, 建立2D线性预测模型, 利用待预测像素周围、因果邻域内的4个像素对待预测像素的索引值进行预测.最后, 采用最小二乘法为每个方向模板计算一组自适应1阶2D线性相关的预测权重系数, 实现沿边缘方向、适用反走样处理的索引图预测编码.实验表明, 本文方法提高索引图的平均预测准确率, 改善边缘反走样区或过渡区的索引值预测效率, 降低时空复杂度.

初始方向预测主要发掘相邻索引值之间的方向相关性.陈规胜等[8]通过实验证实, 相邻索引值之间存在较高的方向相关性, 沿垂直、水平方向的相关性高于沿对角线、反对角线方向的相关性.因此, 在对待编码索引x进行预测时, 首选水平方向相邻索引值的预测方向作为初始预测方向.如果前一索引值沿某个方向D预测成功, 则当前索引x仍然沿方向D进行预测; 否则, 采用MSP的方向预测算法进行初始预测.若仍预测失败, 进入二次方向预测.

本节主要以初始预测为水平方向的情况为例, 介绍二次方向预测(TDP)的过程.

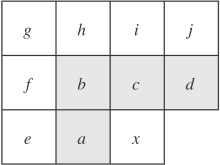

1)由于沿水平方向的初始预测失败, TDP利用待编码索引值x的1阶因果4-邻域索引值Ia、Ib、Ic、Id(如图1)的数值关系判别沿90° 和45° 方向的边缘.

(1)若Ia=Ib且Ia≠ Ic, 则x处可能存在沿90° 方向的边缘, 将Ic作为x的预测值.

(2)若Ia=Ib且Ia≠ Id, 则x处可能存在沿45° 方向的边缘, 将Id作为x的预测值.

2)若沿90° 和45° 方向未能有效判别恰当的预测方向, 表明x可能处于更复杂的几何正则区域, TDP进一步利用2阶因果6-邻域索引值Ie、If、Ig、Ih、Ii、Ij的数值关系判别沿135° 、60° 、120° 、150° 方向的边缘.

(1)若Ia≠ Id, 且If=Ib或Ih=Ib或Ig=Ib或Ic=Ih, 表明x处可能存在150° 、120° 或135° 方向的边缘, 则将Ib作为x的预测值.

(2)若Ia≠ Id, 且Ij=Id者Ij=Ic, 说明x处可能存在60° 方向的边缘, 则将Id作为x的预测值.

(3)若Ia=Id, 且If=Ib或Ig=Ib或Ih=Ib或Ic=Ih, 说明x处可能存在120° 、135° 或150° 方向的边缘, 则将Ib作为x的预测值.

(4)若Ia=Id, 且Ii=Ic或Ij=Ic, 说明x处可能存在60° 方向的边缘, 则将Ic作为x的预测值.

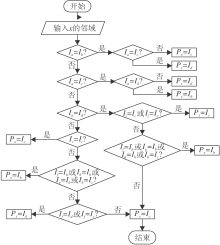

详细预测步骤如图2所示.

若上述条件均不满足, 则表明x未处于明显的几何正则性区域, 导致TDP无法实现有效的方向预测, 默认将Ic作为x的预测值.对于初始预测为其它方向的情况, 预测编码方法见文献[8], 此处限于篇幅不作介绍.

在初始预测失败后, MSP采用待编码索引x的上下文组成4-邻域匹配模板(如图3)进行第二级预测, 可是该模板的预测准确率仅约为53%[25], 效率较差.对于包含复杂线条和图案的屏幕内容, MSP的模板预测精度甚至低于50%[7]. 根本原因在于, 此类图像不具备特定的全局模式, 此时无法发挥模板匹配的非局部预测能力.于是, TDP利用图1所示的方向模板, 发掘屏幕内容的局部相关性, 将索引图的平均预测准确率提高到95.48%.然而尚有4.52%索引值仍无法被模板匹配和TDP进行有效预测. 因此, 本节进一步分析索引值出现方向预测失败的原因.

由1.2节可知:一方面, TDP的方向模板仅考虑沿45° 、60° 、90° 、120° 、135° 、150° 这6个特定方向的边缘; 另一方面, TDP在判别某个索引处的方向时, 必须依靠模板中各个元素的等值关系, 如Ia=Ib且Ia≠ Ic表明x处可能存在90° 边缘.然而边缘反走样过程计算得到的像素值取决于当前像素被物体边缘覆盖的百分比.即使是同一边缘覆盖的两个像素, 像素值也可能存在差异, 不具备TDP方向模板所定义的基于等值关系的局部方向相关性, 这势必导致TDP无法实现反走样像素的有效预测.

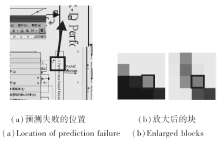

为了说明这一点, 图4和图5分别给出TDP发生索引值预测失败的示例, 图4(b)和图5(b)使用粗黑框突出显示预测失败的索引值位置.从图中可明显看出, 这些索引值恰好位于前景边缘与平滑背景的颜色渐变区, 由于显示适配器开启反走样, 这些索引值与其周围的索引值均不相同, 较好验证上述推论.从这个意义上讲, TDP方向模板预测失败的那些索引值在很大概率上分布于文本、线条和复杂边缘的反走样区域.

| 图5 sc_Programming序列的方向预测失败示例Fig.5 Example of direction prediction failure in sc_Programming sequence |

考虑到屏幕内容中的复杂线条和边缘并不少见, 且边缘反走样和基本颜色量化也是显示适配器的常见操作, 有必要对其引起的预测失败情形以及索引值在发生预测失败时的数值分布规律进行深入分析, 从而有助于设计更有效的方向预测模板. 为此, 本文以JCT-VC (Joint Collaborative Team on Video Coding)公布的17个标准测试视频序列的前90帧为例, 分别利用MSP的初始预测和TDP的二次方向预测进行处理, 统计其中均发生预测失败的全部索引值及其与周围邻域像素组成的812 506个大小为4× 4的图像块.根据索引值的线性相关性及其与边缘的位置关系, 将这些图像块大致划分为2类典型分布.

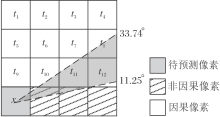

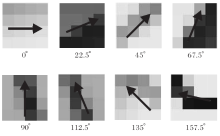

对于服从第1类分布的图像块, 由于边缘反走样处理, 预测失败的索引值分布在2条边缘的连接点处或1条边缘的单侧灰度值渐变区域, 与其因果邻域内的索引值存在线性相关关系.同时, 依据主要边缘梯度方向, 本文将该类图像块细分成8个子类, 如图6所示, 分别对应具有0° 、22.5° 、45° 、67.5° 、90° 、112.5° 、135° 、157.5° 反走样边缘的图像块.

| 图6 方向预测失败的第1类像素块的8种方向分布模式Fig.6 Eight direction distribution patterns in the first class of pixel blocks suffering from directional prediction failure |

对于服从第2类分布的图像块, 预测失败的索引值分布在2条以上边缘的连接、过渡区域或更复杂的几何正则区域, 与其因果邻域内的索引值不存在明显的线性相关关系, 所在的像素块也未呈现规律性的像素值渐变, 如图7所示.

| 图7 方向预测失败的第2类像素块Fig.7 The second class of pixel blocks suffering from directional prediction failure |

进一步, 本文在所有测试序列上统计服从第1类分布的图像块占全体预测失败图像块的比例, 结果如表1所示.

| 表1 第1类索引值分布导致方向预测失败的比例 Table 1 Ratio of directional prediction failure caused by the first class of index distribution |

由表1可见, MSP初始预测和TDP二次方向预测均发生失败的图像块, 平均有57.17%的概率属于第1类索引值分布模式.尤其在PPT_Doc_xls和PCB_Layout等线条丰富、边缘锐利、方向性明显的视频序列中, 平均有70%以上的方向预测失败索引属于第1类索引值分布模式.因此, 第1类索引分布的边缘反走样运算是引起MSP初始预测和TDP二次方向预测出现失败的主要因素, 它在文本、线条丰富的屏幕内容中反映更突出.

由图6可见, 服从第1类分布的图像块具有更复杂的索引值分布模式, 但分布仍然呈现一定的规律性.只要遵循边缘反走样的计算规则, 就可有效地对处于该区域的索引值完成预测编码.鉴于此种情况, 下面针对边缘反走样运算下的索引值自适应预测展开研究.

根据第2节的统计分析结果和第1类像素块的8种索引值分布模式, 本节从Pitteway边缘反走样决策思想出发, 推导并设计8个方向模板.同时, 为了避免预测过程对特定的边缘反走样算法的依赖, 引进基于2D相关的线性预测, 提出面向边缘反走样决策和多方向模板的自适应预测编码方法, 实现更灵活的方向自适应预测能力和更有效的对边缘附近索引值渐变的表示能力.

由于边缘在0° ~360° 范围内具有方向对称性(例如, 沿0° 方向和360° 方向的边缘之间互相平行, 而沿45° 方向和225° 方向的边缘之间也互相平行), 本文将边缘方向的值域区间设置为[0° , 180° ], 进一步均匀划分为8个子方向区间D1~D8, 每个子区间覆盖的角度范围为22.5° .同时, 考虑到第1类像素块的8种索引值分布模式, 选取22.5° 、45° 、67.5° 、90° 、112.5° 、135° 、157.5° 、180° (0° )分别作为8个子区间的主方向角度.表2给出各子区间的具体划分结果.

| 表2 8种子方向区间的划分结果 Table 2 Division results of eight sub-directional intervals |

由于各子方向区间的覆盖范围互有差异, 几何正则性也存在明显差别, 本文为每个子方向区间选取一组用于预测当前索引值的因果像素集合, 得到相应的方向预测模板.根据Pitteway等[32]提出的基于区域采样的边缘反走样思想, 本文将每个像素视作一个具有单位面积的正方形区域, 将直线段视为具有一定宽度的狭长矩形区域, 将每个子方向区间看成覆盖一定面积的三角形扇面.在这种情况下, 对给定的待预测索引x和某个子方向区间, 计算因果邻域内的每个像素与该子方向区间的重叠面积, 即可获得每个因果像素对待预测索引x的贡献.贡献越大, 该因果像素的索引值与x的相关性就越强; 否则, 二者之间的相关性就越弱.鉴于像素值常具有较强的局部相关性, 若2个因果像素与x的重叠面积相同, 则距离x较近者与x的相关性较强, 对x的重构贡献也较大.因此本文提出基于边缘区域面积加权的方向模板设计策略.首先, 度量每个因果像素对索引x的加权重叠面积:

W=

其中, Soverlap表示某个因果像素与子方向区间的重叠面积, Ddist表示因果像素与待预测索引x之间的欧氏距离.再从因果像素集合中选出4个贡献较大者, 作为待预测索引x的参考像素.基于这一思路, 下文以子方向区间D1为例, 讨论方向模板的推导过程.

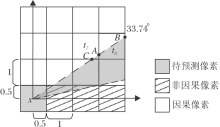

如图8所示, t1~t12表示待预测索引x的因果像素, 含有网格阴影的像素表示x的非因果像素.不难发现, 非因果像素的光栅扫描顺序在x之后, 不能用于预测x的索引值.t1、t2、t3、t4、t5、t6、t9与子方向区间D1的重叠面积为0, 故它们也不能用于预测x的索引值.

为了计算像素t7与D1的重叠面积, 以像素x的中心为原点建立图9所示的直角坐标系, 点C的纵坐标为1.5, 又由点C所在直线的角度为33.74° 可推知, 横坐标为2.25.而点A的横坐标为2.5, 易知纵坐标为1.67, 于是可得像素t7与D1的重叠面积

考虑到

本文选择t8、t10、t11、t12作为待预测索引x的参考像素.

采用上述基于边缘区域面积加权的模板设计方法, 分别为子方向区间D1~D8确定8个方向预测模板, 如图10所示, 图中a、b、c、d表示待预测索引x的4个因果参考像素, 相应的数字表示该模板覆盖的角度区间.由图可见, 本文模板能根据边缘的几何正则性和边缘反走样的决策, 为待预测索引x自适应地选择参考像素.但是, 由于不同的屏幕视频往往是由不同显示适配器和应用软件生成, 采用的边缘反走样算法也多种多样, 因此, 图10的方向预测模板仅能确定恰当的参考像素, 而每个参考像素对像素x的权重取决于具体的反走样算法.综上所述, 本文提出基于2D线性相关的预测权重估计策略, 根据屏幕内容视频的关键帧自适应地为参考像素a、b、c、d学习得到一组预测权值, 从而摆脱预测过程对特定边缘反走样算法的依赖.

依据Pitteway边缘反走样的过程, 针对处于理想边缘附近、反走样区域中的像素, 像素值取决于它与理想边缘的重叠面积.若重叠面积为A, 则像素值等于理想边缘的像素值的A%.由此可见, 反走样区域的各个像素值与理想边缘像素值之间存在线性相关关系.一方面, 在图10的8个预测模板中, 待预测索引x及其4个参考像素均为沿理想边缘方向、与相应子方向区间具有最大重叠面积的像素, 表明它们之间也将以理想边缘的像素值为媒介, 呈现一定的线性相关关系.另一方面, 沿着垂直于理想边缘方向的像素, 距离理想边缘越远, 它们与理想边缘的重叠面积就越小, 甚至没有重叠区域, 如图11所示, 这表明它们的像素值与理想边缘值之间的相关性很弱或不具有相关性.因此, 本文8个预测模板中的参考像素是待预测像素x周围、与x线性相关性最大的4个像素.于是, 采用2D线性相关模型建模待预测像素x与其4个参考像素的相关关系, 实现有效预测像素x的索引值, 定义如下:

Ix=

其中:Ix表示待预测像素x的索引值;

为了求解每种预测模式的4个相关系数, 首先在视频序列中选取若干关键帧组成训练集T, 计算全部像素的平均索引值μ .再针对T中每个像素p, 利用Sobel算子分别计算p处沿着水平方向的1阶差分∂ Ip/∂ x和沿着竖直方向的1阶差分∂ Ip/∂ y, 计算像素p处的梯度角方向:

$\theta_{p}=\arctan \left(\frac{\partial I_{p}}{\partial y}\left(\frac{\partial I_{p}}{\partial x}\right)^{-1}\right)$(3)

其中Ip表示像素p的索引值.

进而, 计算像素p的主方向角:

最后, 将所选关键帧划分为若干个大小为4× 4像素的子块, 统计每个子块的主方向角的直方图, 将出现次数最多的作为该子块的主方向角

设训练集Ti含有Ni组训练数据, 欲获得第i种预测模式的最优预测精度, 就需使相关系数

arg

其中,

其中,

u∈ {x, a, b, c, d}, v∈ {x, a, b, c, d}.进一步, 求解式(6)所示的方程组, 得

在此基础上, 将所得

即可利用给定的参考像素的索引值

算法 1 基于边缘反走样决策的索引值自适应预测

输入 长度为F帧的待编码视频序列V,

8种预测模式的参考像素模板,

预测权重的更新周期L, 1≤ L≤ F

输出 索引图的预测误差

step 1 令f← 1, ch← 1.

step 2 提取V的第f帧、第ch个颜色分量.

step 3 应用文献[26]的方法计算第f帧、第ch个颜色分量的索引图, 将每个像素p量化为索引值Ip.

step 4 若f%L=1, 第f帧为关键帧并转入step 5, 否则第f帧为非关键帧, 转入step 7, 其中“ %” 表示模运算.

step 5 将关键帧的第ch个颜色分量划分为大小为4× 4的子块组成训练集T, 训练2D线性相关的预测权重.

step 5.1 计算关键帧的第ch个颜色分量中全部像素的平均索引值μ , 对每个子块执行step 5.2~step 5.6.

step 5.2 利用Sobel算子计算每个像素p处沿水平方向的1阶差分∂ Ip/∂ x和沿竖直方向的1阶差分∂ Ip/∂ y, 根据式(3)计算每个像素p处的梯度角方向θ p.

step 5.3 根据每个像素p的梯度方向角θ p和式(4)计算主方向角

step 5.4 统计子块中所有像素的主方向角的直方图, 确定当前子块的主方向角

step 5.5 将子块的索引值减去μ , 按照第i种预测模式的像素分布位置(图10)取出像素x及其参考像素的索引值, 作为训练集Ti的一组训练数据.

step 5.6 应用训练集Ti(1≤ i≤ 8)及式(5)~式(8), 计算第i种方向预测模式的预测权重.

step 6 按照光栅扫描顺序, 预测关键帧的第ch个颜色分量中每个像素p的索引值Ip.

step 6.1 对于待预测的索引值Ip, 采用TDP二次方向预测方法进行预测, 令其预测值为

step 6.2 输出预测误差Ip-

step 7 计算非关键帧的第ch个颜色分量中全部像素的平均索引值μ n, 并按照光栅扫描顺序处理每个像素x.

step 7.1 对于像素x的索引值Ix, 采用TDP二次方向预测方法进行预测, 令其预测值为

step 7.2 令像素x左侧的相邻像素为p, 采用后向差分法, 分别计算像素p的索引值Ip沿水平方向的1阶差分∂ Ip/∂ x和沿竖直方向的1阶差分∂ Ip/∂ y, 根据式(3)计算像素p处的梯度角方向θ p.

step 7.3 根据像素p的梯度方向角θ p和式(4), 计算主方向角

step 7.4 根据主方向角

step 7.5 输出预测误差Ix-

step 8 令ch← ch+1, 若ch> 3, 转入step 9, 否则转入step 2.

step 9 令f← f+1, ch← 1, 若f≤ F, 转入step 2, 否则算法结束.

为了验证本文方法的有效性, 选用JCT-VC公布的17个标准测试序列(见表3)的前90帧进行实验, 同时考虑到上述序列包含的中英文字符不多且屏幕视频在字符边缘处常会开启反走样, 本文又选取文献[8]给出的3段包含英文字符、简体中文字符、繁体中文字符的屏幕视频.全部屏幕视频共包含2 477 537 280个索引.

| 表3 标准的屏幕视频 Table 3 Standard screen videos |

首先, 利用文献[26]方法计算得到各个颜色分量的索引图, 再采用本文方法进行预测并统计预测准确率, 同时将结果与如下方法进行对比:MSP[25]、基于双向反馈的预测算法(Bi-directional Feedback Prediction, BDFP)[28]、渐变拷贝算法(Transition Co-py, TC)[14]、基于2D马尔可夫的局部预测算法(2D Markov Local Prediction, 2DMLP)[30]、2-邻域联合转移概率的预测算法(2-Neighbor Joint Transitional Probability Prediction, 2NJTPP)[31]、自适应行列拷贝预测算法(Adaptive Line and Column Copy Prediction, ALCCP)[2]、行拷贝预测算法(Line Copy Prediction, LCP)[22]、基于误差软阈值的模板匹配多级预测算法(Enhanced Soft Context Formation, ESCF)[9].

参数设置为F=90, L=15.实验环境如下:Intel Core (TM) i5-4590 CPU @3.30 GHz, 16.0 GB主存, 64位Windows 7旗舰版操作系统.

各方法在视频序列上的预测准确率对比如表4所示.LCP、ALCCP、MSP、BDFP的方向预测能力逐渐增强.TC、2DMLP、2NJTPP增加对相邻索引值间的颜色转移关系的描述机制.ESCF引入误差软阈值机制, 在一定程度上缓解预测过程对相邻像素之间等值关系的依赖.

| 表4 各方法的预测准确率对比 Table 4 Prediction accuracy comparison of different methods |

由表4可见, LCP仅利用相邻行之间的相关性进行预测, 初始预测精度仅为76.90%.算法进一步引进帧内块匹配技术完成二次预测, 将平均准确率提高至92.69%.但是, 块匹配方式无法实现对块内索引值的精确预测, 需以边信息的方式传输预测误差和偏移向量.ALCCP兼顾相邻行、列之间的相关性, 在未借助帧内块匹配技术的前提下, 平均预测准确率可达到91.95%, 时间效率较高, 但预测方向仅限于水平方向和竖直方向.MSP由于发掘沿水平、竖直和45° 这3个方向的局部相关性, 并利用模板匹配运算进行二次预测, 去除重复图案的全局相关性, 因此平均预测准确率为93.36%.相比LCP、ALCCP, MSP有一定提升.BDFP进一步考察索引分配过程与局部方向预测过程的相互作用, 通过最大化前向预测和后向预测的联合概率, 将平均预测准确率提高2.96%, 达到96.32%.但是, 上述4种方法均依赖索引值之间的等值关系以实现局部方向预测, 而边缘反走样区域的像素值却取决于它与物体边缘的重叠面积.即使相邻的两个像素, 索引值也可能不同, 因此, 这四种方法在边缘反走样区域的索引预测效率有限.

在MSP的初始预测基础上引进颜色转移表, 描述相邻索引值沿水平方向的转移关系, TC能在一定程度上处理反走样区域的索引值, 平均预测准确率为94.95%.这表明在预测过程中考虑颜色渐变有利于提高索引图的预测准确率.但是, 由于缺乏边缘方向性的判断机制, TC的预测准确率仍低于BDFP.当引入沿0° 、45° 、90° 和135° 方向的转移概率后, 相比TC, 2DMLP的平均预测准确率提升2.63%, 达到97.58%.2NJTPP采用2-邻域匹配模板预测物体或文字边缘处沿± 45° 和± 135° 的特定转移模式, 取得一定效果, 平均预测准确率达到97.77%.由此可见, 兼顾考虑边缘方向性和颜色渐变能进一步改善索引图的预测效率.

然而, TC、2DMLP、2NJTPP的预测模板及其参考像素是固定的, 无法对沿着复杂方向的边缘索引值进行有效预测.ESCF综合运用帧内块拷贝和模板匹配方法, 降低索引值的局部/全局相关性, 引进匹配误差的软阈值策略, 增强预测过程对颜色渐变的适应能力, 取得较优的预测性能, 平均预测准确率为98.16%.ESCF的匹配模板也是单一的6-邻域模板, 不具备较好的边缘方向自适应性, 无法对0° 、45° 、90° 和135° 以外的边缘方向进行有效判断.本文方法引进基于反走样决策的8种方向预测模板和基于2D线性相关的预测权重估计, 可借助关键帧的自适应训练, 更有效地捕获边缘方向及其反走样模式, 相比MSP、BDFP、TC、2DMLP、2NJTPP、AL-CCP、LCP、ESCF, 本文方法平均预测准确率分别提升5.01%、2.89%、3.42%、3.34%、0.79%、0.60%、6.42%、5.68%、0.21%, 几乎准确预测TDP二次方向预测无法预测的索引值中服从第1类分布模式的那些索引值(约占57.17%), 甚至还成功预测服从第2类分布模式的一部分索引值.

特别地, Video_Conferencing、BasketballDrillText、Map、WordEditing、PPT_Doc_xls视频序列不仅包含文字字符和不同方向的线条, 还包含由计算机生成的大量几何图元和复杂场景.为了使曲线边缘看起来更光滑, 显示适配器开启边缘反走样, 相比MSP、BDFP、ALCCP、LCP、TC、2DMLP、2NJTPP、ESCF, 本文方法的预测准确率分别提升7.28%、2.33%、9.43%、8.10%、3.96%、1.01%、1.08%、0.27%.为了削弱文字边缘的锯齿效应, 英文文本、简体中文文本、繁体中文文本视频序列也启用反走样操作, 相比MSP、BDFP、TC、2DMLP、2NJTPP、ALCCP、LCP、ES-CF, 本文方法的预测准确率分别提升11.69%、6.85%、12.33%、7.26%、7.98%、2.95%、1.69%、1.19%.

由上述分析可见, 在开启反走样处理的边缘区域, 本文方法的索引值预测性能优于其它对比算法.然而, 对于平滑区域较多的测试序列(如 SlideShow), 各种方法均已达到较高的准确率, 本文方法的性能提升不如上述序列那么明显.由此可见, 本文方法较适用于边缘、纹理复杂的屏幕内容索引图编码.

由本文方法步骤可知, 只有当TDP的二次方向预测失败时, 才在非关键帧上执行基于边缘反走样决策的索引值自适应预测.一方面, 第2节的大量实验统计结果显示, TDP预测失败的索引数量仅占全部待预测索引的4.52%.另一方面, 对于非关键帧来讲, 8种方向预测模式的2D线性相关的预测权重是已知的.即使在最坏的情况下, 本文方法也只需对1个待编码索引值进行1次边缘方向的判断, 再利用4个参考像素进行4次乘法、4次加法和5次减法, 即可得到预测误差.因此, 本文方法预测1个索引值的渐近时间复杂度为O(1).而对于关键帧来说, 计算2D线性相关的预测权重的时间复杂度为O(N), N为训练数据量, 这些预测权重一经确定后, 能在后续的非关键帧中重复使用.综合上述分析, 本文方法处理1个索引值的平均时间复杂度约为O(1), 是MSP的1/WT, W表示MSP在模板匹配时搜索窗口中的待匹配索引数目, T表示模板包含的参考像素数量[25].

各方法在20个视频序列上的具体运行时间如表5所示.由表可见, ALCCP仅需判断每个待预测索引与其上方和左侧索引的等值关系, 预测速度最快, 平均需0.33秒/帧.本文方法、2DMLP、2NJTPP增加2D线性相关系数或转移概率的训练过程, 平均运行时间均为0.35秒/帧.需要指出的是, 2D线性相关系数的训练复杂度体现在内存计算方面, 而转移概率的训练复杂度主要体现在访存查表方面, 3种方法均只应用在占索引总数4.52%、初始预测失败的索引上, 故平均计算时间相差无几.TC在MSP初始搜索基础上, 需要计算全部索引的1D颜色转移表, 访存查表运算的次数多于2NJTPP, 平均运行时间为0.44秒/帧.MSP在局部方向预测失败的情况下, 借助全局模板匹配完成第二阶段的预测, 平均运行时间达到5.38秒/帧.LCP既要执行全局块匹配操作, 又需判断每个待预测索引与其上方索引的等值关系, 再在两种预测模式之间进行优化选择, 平均运行时间大于MSP, 达到5.56秒/帧.ESCF采取编码单元内部预测、全局模板匹配、调色板更新和自适应中值预测(Median Adaptive Prediction, MAP)4个阶段的预测策略, 付出更高的计算代价, 平均运行时间为10.87秒/帧.BDFP需在索引分配和索引预测两方面进行权衡, 平均运行时间最长, 达到11.18秒/帧.相比MSP、BDFP、LCP、TC、ESCF, 本文方法平均运行效率分别提升93.49%、96.87%、93.71%、20.45%、96.78%.当然, 方向模板的预测权重训练也增加方法的总体运行时间, 故本文方法的运行效率略低于ALCCP.

| 表5 各方法的实际运行时间对比 Table 5 Running time comparison of different methods 秒/帧 |

本文通过分析MSP和TDP发生局部预测失败的索引值分布模式, 发现大部分索引均分布在2条边缘的连接点处或1条边缘的单侧灰度值渐变区域, 并且由于边缘反走样处理, 它们与其因果邻域内的索引值表现出线性相关关系.进而, 引进Pitteway面积加权的边缘反走样决策, 推导并设计8个方向预测模板.在此基础上, 为了避免参考像素的加权预测过程对特定边缘反走样算法的依赖, 提出基于边缘反走样决策和多方向模板的自适应预测编码方法, 能利用少量关键帧训练一组恰当的预测权重, 从而具备对显示适配器的反走样算法的自适应能力.实验结果表明, 本文方法的预测准确率较高.

需要指出的是, 本文方法较适用于边缘、纹理复杂的屏幕内容索引图编码, 尤其是开启反走样操作、富含文字区域的索引图预测编码.对平滑区域较多的屏幕内容, 以及服从第2类分布、不具备1阶线性相关的像素值渐变, 本文方法的预测性能提升不够明显, 并且, 本文方法需要每隔15帧训练一次2D线性相关系数, 会在一定程度上增加预测编码过程的计算复杂度.在今后的工作中, 拟深入研究屏幕内容分布特性的自适应判断和2D线性相关系数的自适应更新策略, 进一步降低训练过程的计算量.

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|

| [13] |

|

| [14] |

|

| [15] |

|

| [16] |

|

| [17] |

|

| [18] |

|

| [19] |

|

| [20] |

|

| [21] |

|

| [22] |

|

| [23] |

|

| [24] |

|

| [25] |

|

| [26] |

|

| [27] |

|

| [28] |

|

| [29] |

|

| [30] |

|

| [31] |

|

| [32] |

|