陈 鹏,博士,教授,主要研究方向为机器视觉、数据分析.E-mail:pchen.ustc10@foxmail.com.

作者简介:

黄 健,硕士研究生,主要研究方向为计算机视觉、图像处理.E-mail:hjgogoing@163.com.

郑春厚,博士,教授,主要研究方向为数据分析、生物信息学.E-mail:zhengch99@126.com.

章 军,博士,教授,主要研究方向为模式识别、智能信息处理、生物信息学.E-mail:wwwzhangjun@gmail.com.

王 兵,博士,教授,主要研究方向为智能信息处理、机器视觉、图像处理.E-mail:wangb@ahut.edu.cn.

将小样本学习中的度量学习方法引入缺陷检测领域,提出小样本度量迁移学习方法,用于解决深度学习方法中需要大量学习样本的问题.方法主要分为两个阶段:第一阶段使用公开或便于获得的大型数据集预训练深度网络;第二阶段将网络学习到的相关知识通过度量学习模块迁移到表面缺陷检测领域.实验表明,小样本学习在缺陷检测领域的可行性.

CHEN Peng, Ph.D., professor. His research interests include computer vision and data analysis.

AboutAuthor:

HUANG Jian, master student. His research interests include computer vision and image processing.

ZHENG Chunhou, Ph.D., professor. His research interests include data analysis and bioinformatics.

ZHANG Jun, Ph.D., professor. His research interests include pattern recognition, intelligent information processing and bioinformatics.

WANG Bing, Ph.D., professor. His research interests include intelligent information processing, computer vision and image processing.

Metric learning method of few-shot learning is introduced into the field of defect detection, and a few-shot learning method based on transfer metric learning is proposed to meet the requirement of deep learning method for a large number of learning samples. In the first stage, the deep network is pre-trained on the large datasets which are open or easy to be obtained. In the second stage, the relevant knowledge learned by the network is transferred to the field of surface defect detection through the metric learning module.Experiments show the feasibility of few-shot learning in defect detection.

本文责任编委 桑农

Recommended by Associate Editor SANG Nong

随着工业产能和日常使用量的增加, 在生产或使用过程中常出现各种瑕疵或缺陷.传统的人工检测已不能适应日益发展的社会生产需求, 而且由于人类自身精力和工作时间的限制, 难以长时间依赖人工质量检查.因此, 基于机器视觉的缺陷检测方法逐渐成为人们探索的目标.刘泽等[1]利用机器视觉的方法检测钢轨表面的缺陷.李景彬等[2]检测农产品相关的缺陷.何存富等[3]利用小波降噪检测钢绞线表面缺陷.但是, 在缺陷检测领域, 由于表面纹理的变化及缺陷种类的不同, 需要复杂的模型满足不同的使用需求.这对于依赖人工前期处理的传统机器学习模型来说, 是一个非常大的挑战.

近期, 随着深度学习尤其是卷积神经网络(Convolutional Neural Network, CNN)的发展, 使解决这个难题成为可能.它们能在大量数据中学会构造复杂特征, 适应多样的应用领域, 取得良好性能.AlexNet[4]、VGG模型(Visual Geometry Group Network, VGGNet)[5]、残差网络(Residual Network, ResNet)[6]等深度学习网络架构也被广泛运用.Masci等[7]指出, 在表面缺陷检测方面, 相比机器学习方法, 深度学习方法具有明显的性能优势.

王宪保等[8]利用深度学习检测太阳能电池片的缺陷, 取得良好效果.刘云等[9]使用CNN实现苹果缺陷检测.王永利等[10]提出基于深度学习的印刷电路板(Printed Circuit Board, PCB)缺陷检测算法, 以CNN作为基础, 构建缺陷检测模型, 实验证实识别率高于传统依赖手工特征提取方法.

金侠挺等[11]发展深度学习语义分割框架Deep-Lab v3+[12], 成为轻量级的神经网络, 使用丢弃(Drop-out)和改进的深度可分离卷积(Depthwise Separable Convolutions, Xception)网络等技术[13], 实现钢轨表面缺陷的分割.Zhang等[14]提出分类感知目标检测网络(Category Aware Object Detection Network, CAD-N)的弱监督学习方法.CADN同时配备一个大型网络和一个轻量级的网络作为特征提取器, 使用知识蒸馏的策略迫使一个较轻量级的网络模仿一个大型网络的行为, 提高轻量级网络的性能.因此, 该方法在保持较高实时性的同时提高模型精度.

然而, 上述方法总是面对需要大量数据的难题.快速区域CNN(Faster Region-Based CNN, Faster RCNN)[15]、多路优化网络(Multi-path Refinement Net-work, RefineNet)[16]等深度学习方法也都是建立在大量数据基础上的, 这在一定程度上限制其在应用领域的发展.尤其是在工业生产中, 由于其特殊性, 研究人员往往很难获得大量用于学习的数据.小样本学习的提出正是为了突破深度学习需要大量数据这一限制, 使其更适合缺陷检测这一特殊领域.因此, 本文提出小样本的度量迁移学习方法(Few-Shot Metric Transfer Learning Network, FmTL-Net), 将小样本学习中的度量学习方法引入缺陷检测中.小样本度量学习能利用度量分类的方式, 将从大量数据上学习的知识有效迁移到缺陷检测领域, 进一步提高缺陷检测领域的自动化程度, 在大量减少人力资源消耗的同时提高工作和生活的效率.

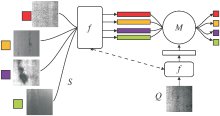

小样本学习属于深度学习的一种, 是在深度学习的基础上发展而来的.本文提出基于小样本的度量迁移学习网络(FmTLNet), 学习流程如图1所示.方法主要由支持集(S)、查询集(Q)、特征嵌入模块(f)、度量模块(M)组成.通过CNN同时提取支持集和查询集的特征, 查询集数据和支持集数据按特征相似性映射到相同特征空间中, 再计算查询集样本和支持集样本之间的特征相似性, 以此分类查询集中的图像.

小样本是指已知类别样本或可供学习的样本非常稀缺.这里假设S为一个支持集, 在支持集中包含C个类别的图像, 每个类别包含K个已标注的样本图像.给定一个查询集Q, Q中每个样本都是待检测类别的样本.这样的问题也被叫做C-way K-shot分类.然而, 当样本量很少, 即K值非常小时, 一般的机器学习和深度学习方法很难获得良好的分类效果.小样本学习的目标是通过有限的支持集S对查询集Q中未分类的样本进行准确分类.

为了解决这个问题, Vinyals等[17]提出情景训练模式, 在这种学习方式下, 每次迭代只训练少量样本.这些少量样本需要从原始数据集中随机采样获得.这种训练模式主要是为了增强知识的迁移能力.具体地, 构建一个小型数据集S, S中有C个确定类别的样本, 每个类别K个样本.同时, 再通过随机采样的方式构建查询数据集Q.在训练迭代中不断通过随机采样的方式构建小型样本集训练网络.在测试过程中, 需要遵循同样的模式, 训练好的模型可通过构建的支持集S识别查询集Q中每个待检测样本.值得注意的是, 训练集与测试集的类别标签不重合, 可将训练集称为源域, 测试集称为目标域.因此, 让网络从一个大型的分类数据集, 即源域中学习, 学会对不同类别样本的区分能力, 再将这种区分能力用于缺陷检测领域.

在有足够多数据的情况下, 深度学习网络可通过学习将图像有效压缩成一个特征表示.然而, 在样本量极度稀缺时, 这种方式会丢失图像中许多有用的局部信息.因此, 利用全局信息的方法, 如原型网络(Prototypical Network)[18]可能并不能取得令人满意的效果.本文采用文献[19]的深度最近邻神经网络(Deep Nearest Neighbor Neural Network, DN4), 把图像的局部信息作为类别以区分, 这是一种更适合类别相似度计算的度量方式.基于DN4的度量方法流程如图2所示.图中查询集图像和支持集图像通过特征嵌入模块提取特征, 获得h× w× d的特征图.沿着特征图高、宽的方向将每个位置的局部特征向量视为原图不同位置的特征描述, 特征维度为特征图通道数量d, 则

ψ (x)=[x1, x2, …, xm]∈ Rd× m,

其中m=h× w.对于查询图像q的每个特征描述符xi, 在类别c中寻找前k个最相近的局部特征向量

$\Phi (\psi (q), c)=\overset{m}{\mathop{\underset{i=1}{\mathop{\sum }}\, }}\, \overset{k}{\mathop{\underset{j=1}{\mathop{\sum }}\, }}\, cos({{x}_{i}}, x_{c}^{j}), $

$cos({{x}_{i}}, x_{c}^{j})=\frac{{{x}^{\text{T}}}_{i}x_{c}^{j}}{\left\| \left. {{x}_{i}} \right\|\left\| \left. x_{c}^{j} \right\| \right. \right.}, $

其中cos(· , · )为计算余弦相似度.

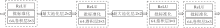

在度量学习中, 特征嵌入模块是任意的由全卷积神经网络构成的模块.在小样本学习中, Conv-64F成为常用模块[20].本文采用的基于Conv-64F模块的网络结构如图3所示.FmTLNet由卷积层核尺寸为3× 3, 数量为64的CNN同时结合批标准化(Batch norm)和ReLU激活函数组成.不同于原始的Conv-64F网络结构, FmTLNet取消最后2个最大池化层, 这样做的目的是为了提高最后输出的特征图的分辨率, 以便留有足够的局部特征信息.

本文选择交叉熵损失函数作为损失函数, 分类分数转化为分类概率:

$p(y=c|q)=\frac{\text{exp}\left( \Phi \left( \text{ }\!\!\psi\!\!\text{ }\left( \text{q} \right), \text{c} \right) \right)}{\underset{c'}{\mathop{\sum }}\, \text{exp}\left( \Phi \left( \psi \left( q \right), c' \right) \right)}, $

$l=-\overset{n}{\mathop{\underset{i=1}{\mathop{\sum }}\, }}\, {{y}_{i}}ln(p(y=c|q)), $

其中yi为样本标签.

为了模型能学习足够泛化到新数据集上的分类能力, 本文需要一个大型数据训练模型, 这个数据集也可称为基类.选取小样本学习领域中常用的数据集miniImageNet[17]作为基类以训练模型.miniImage-Net数据集包含100个类别, 每个类别包含600个样本.miniImageNet数据集上所有样本全部来自ImageNet数据集[21].

NEU为钢材表面缺陷数据集[22], 本文针对NEU数据集展开小样本学习的研究, NEU数据集共有6类表面缺陷(细裂纹、夹杂、斑块、麻点面、氧化铁皮压入、刮痕), 每类缺陷包含300个样本.

FmTLNet首先需要应用miniImageNet数据集训练网络, 获得良好的分类能力.对于miniImageNet数据集上100个类别, 随机划分80个类别作为训练集, 剩下的20个类别作为验证集.验证集的类别与训练集的领域不相交.在训练过程中, 对训练集按照类别进行随机采样, 每次迭代训练随机选取6类, 每类别选择10个样本作为支持集.再从6类剩下样本中每类随机选取10个样本组成查询集.每次迭代中共有120个样本参与训练.

评价标准选用准确率(Accuracy, Acc):

Acc=

其中, TP+TN表示正确预测的样本数, total表示样本总数.

使用文献[19]类似方式在测试集上进行验证, 即共在测试集上进行600次测试, 取平均结果作为最终结果.这样做的目的是为了排除由于测试样本太少而产生特殊结果, 使结果不可信.

一般来说在样本量非常少的情况下, 机器学习方法和深度学习方法都难以取得满意性能.在实验过程中, 度量方式中的超参数k=3.其它方法的数据划分与小样本学习的数据划分采用类似方式, 即每次实验中, 从缺陷数据集中每类随机抽取5个样本(5-shot)或10个样本(10-shot)进行训练, 再随机选择10个样本测试网络.

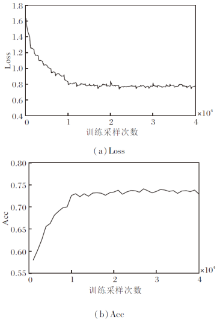

FmTLNet在不同训练采样次数下的Acc值和损失值(Loss)曲线图如图4所示.

在训练过程中, 随着训练集上的Loss值逐渐减少, 网络在验证集上的性能不断提高, 说明FmTLNet可学到适用于新领域的分类性能.

另外, 将训练好的网络在NEU数据集上进行测试.为了更好地表现FmTLNet与传统深度学习在性能上的差异, 对VGG16和ResNet50进行性能测试, 并采用在miniImageNet数据集上预训练(pre)和从头学习2种方式测试网络性能.FmTLNet采用第1种学习方式, 实验结果如表1所示.

| 表1 各方法在NEU数据集上的Acc值对比 Table 1 Acc value comparison of different methods on NEU dataset % |

由表1可见, FmTLNet表现最优, 5-shot的Acc值达到92.09%, 10-shot的Acc值达到95.09%.其它方法的Acc值较差, 这可能是由于样本太少导致出现过拟合现象.另外, 采用预训练测试方式的网络性能优于采用从头学习方式网络, ResNet50的Acc值提高30%~40%.小样本学习的方式没有直接使用一个分类器, 如基于全连接层进行分类, 而是通过计算特征相似度的方式实现缺陷分类.这种无参数的分类方式使网络不用直接关心特征输出值, 真正的分类任务移交给距离度量模块.这种间接分类的方式使网络在样本量很少时提高分类能力.

进一步地, 在训练时每类取5个样本或10个样本作为支持集, 测试时每类也取5个样本或10个样本作为支持集, 对比FmTLNet性能.实验结果如表2所示.由表可见, 训练集和测试集都为5个样本时, 网络性能略有提升, 这说明训练集和测试集采用相同的取样可能更适合网络学习.另外, 训练集和测试集都为10个样本时, FmTLNet性能表现最优.因此在本文的后续实验中训练都采取每类10个样本取样的方式.

| 表2 FmTLNet在不同设置下的Acc值对比 Table 2 Acc value comparison of FmTLNet in different settings % |

特征嵌入模块是小样本学习中重要的组成部分, 为了研究不同嵌入模块在性能表现上的差异性, 分别使用Conv-64F、宽残差网络(Wide ResNet, WRN-28-10)[23]作为特征嵌入模块, 进行相关实验.实验结果如表3所示.

| 表3 使用不同网络结构的性能对比 Table 3 Performance comparison of different network structures |

由表3可知, Conv-64F参数最少, 表现最优.这是因为源域数据(miniImageNet数据集)和目标域数据(NEU数据集)之间差距较大, 方法能通过源域数据学习分类能力, 但是过多的参数使模型过度拟合源域数据, 迁移能力下滑.参数更少的Conv-64F能在一定程度上减轻过度拟合源域数据集的问题, 网络学习能力能更好地泛化到缺陷检测领域.

在迁移学习中广泛使用微调的方式.本文认为这种方式同时适用在小样本学习上, 使方法更适应工作领域.在测试过程中, 每个类别只有5个或10个样本是已知类别, 然而, 稀少的样本重新划分成新的支持集和新的查询集可能会导致效果不佳.因此, 将数据增强加入方法中.

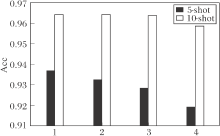

首先, 在微调过程中使用旋转和镜像等方式将支持集增至两倍, 即每个类别含有10个或20个样本.在每次微调迭代中:在5-shot情形下, 随机重新划分出4~6个样本作为新的支持集, 剩下的样本作为新的查询集; 在10-shot情形下, 随机重新划分出6~10个样本作为新的支持集, 剩下的样本作为新的查询集.每次测试时重新训练100次.在训练过程中每次迭代都重新进行随机数据增强, 新的支持集划分也是遵循随机划分的方式, 这里采用随机的方式是为了增加微调时样本组合的多样性.通过数据增强不仅增大数据量, 还使新增的图像与原始图像的同一缺陷在不同位置, 有利于网络学习如何更好地表达缺陷的特征.如图3所示, 分别进行微调最后1个卷积层、最后2个卷积层、3个卷积层、全部4个卷积层.实验结果如图5所示.

| 图5 对不同卷积层进行微调的方法的Acc值对比Fig.5 Acc value comparison of methods with different convolutional layers fine-tuned |

由图5可知, 微调的方式可有效提升方法性能.但是, 随着微调网络层数的增加, 性能总是先增加后降低.这是由于方法会越来越拟合用于微调的少量数据, 导致随着层数的增加, 方法性能总体呈现下降趋势.这种趋势在10-shot情况下迟一些, 这得益于增强之前用于微调的数据量大于5-shot.

为了对比, 在测试时将支持集扩充为原来的两倍, 同时只微调第1卷积层.实验结果如表4所示.由表可知, 测试时对支持集进行数据扩充, 可在一定程度上提升方法性能, 但是提升效果有限.因此, 为了保持5-shot和10-shot这一标准, 后续实验都将采用原始的支持集.

| 表4 支持集扩充对方法Acc值的影响 Table 4 Effect of support set expansion on Acc value % |

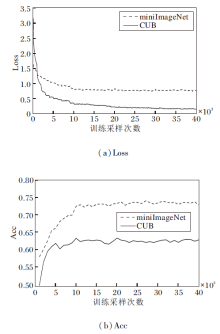

从小样本学习的机制上看, 网络在源域学到的知识对于最后缺陷的识别有很大影响.因此, 本文引入新的数据集作为网络需要学习的源域.CUB-200-2011数据集(CUB)[24]是常用于细粒度分类的鸟类数据集, 包含来自200种鸟类, 总共11 788幅图像.在CUB数据集上进行相同的实验.

训练过程Loss与验证集上的Acc变化曲线如图6所示.由图可看到, 在CUB数据集上的Loss值低于miniImageNet数据集.在CUB数据集上训练时, 网络在训练集上的表现更优.然而, 在miniIma-geNet数据集上训练的方法在验证集上表现更优.

在针对缺陷数据集进行分类时, 同样通过微调的方式实现领域适应, 只微调训练最后一层卷积, 微调100次.最终的实验结果如表5所示.由表可知, 在CUB数据集上训练的网络在缺陷数据集上测试时, 表现依旧较差.这是由于CUB数据集上每个类别样本量太少, 类内之间的差异性没有miniImage-Net数据集明显造成的.因此, 网络通过miniImage-Net数据集学习后获得更强的可供泛化到新领域的能力.

| 表5 不同源域上FmTLNet的Acc值对比 Table 5 Acc value comparison of FmTLNet from different source domains |

FmTLNet在这2个不同源域数据集上进行学习后, 通过性能表现对比可知, 小样本学习的性能与从源域学习到的分类能力关系密切.在数据量更多、更复杂的miniImageNet数据集上学习时, FmTLNet在5-shot时Acc值达到93.69%, 在10-shot时Acc值达到96.42%.然而, 在相对简单的CUB数据集上学习时, 在5-shot和10-shot情况下, Acc值分别只能达到90.96%和94.81%.这说明在数据量多及种类复杂的数据集上学习时, FmTLNet有机会获得相对较优的性能.

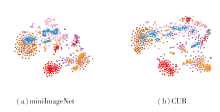

为了更好地对比分析特征嵌入模型能否有效表达各个类别的特征, 以及从不同领域学习的方法在NEU数据集上的表现差异, 在NEU数据集上使用t-分布随机近邻嵌入(t-Distribution Stochastic Neigh-bour Embedding, t-SEN)可视化6个类别、每个类别100个样本的特征嵌入, 如图7所示.

由图7可知, 2个不同的源域训练的方法都能较好地区分每个类别, 这说明FmTLNet可正确区分样本.从这2个可视化图对比中可看到明显差异, 在miniImage-Net数据集上学习的方法的区分度优于NEU数据集.

综合上述分析可知, 小样本度量学习通过在非相关的大型数据集上学习, 使网络能利用较少的样本(5幅或10幅图像)获得较优性能, 在缺陷检测过程中减少对缺陷样本量的需求, 提升工作效率, 满足快速应用的需求.然而, 从实验过程上看, 小样本度量学习对源域较敏感.源域复杂度、类别数及样本量的不同都可能造成性能的明显差异.不同特征嵌入模块的对比实验表明, 模型规模的大小影响性能.

本文研究小样本学习中度量学习在缺陷检测领域的应用, 通过相关实验证实小样本学习可在获得样本量很少的情况下实现缺陷检测的可能性.度量学习通过计算相似度的分类方式, 可将从源域学习到的分类能力迁移到全新的领域.在小样本度量学习的基础上, 本文还将数据增强、重新划分和微调的方式引入度量学习方法.通过一定的实验证实数据增强再微调的方式对度量学习有一定的增益效果.不仅如此, 本文还研究不同源域对方法性能的影响, 通过实验表明复杂的源域数据能在一定程度上增强方法性能.今后需要探索规模与性能之间的最佳平衡点, 因此, 需要设计一个更好的学习方式、网络结构和度量方式, 更好地将源域的知识迁移到缺陷检测领域中.

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|

| [13] |

|

| [14] |

|

| [15] |

|

| [16] |

|

| [17] |

|

| [18] |

|

| [19] |

|

| [20] |

|

| [21] |

|

| [22] |

|

| [23] |

|

| [24] |

|