黄哲煌,博士,副教授,主要研究方向为粗糙集、粒计算.E-mail:hqufuzzy@163.com.

作者简介:

吴家明,硕士研究生,主要研究方向为粗糙集、不确定性分析及其应用.E-mail:wjmfuzzy@163.com.

李进金,博士,教授,主要研究方向为一般拓扑学、粗糙集、概念格.E-mail:jinjinlimnu@126.com.

刘丹玥,硕士研究生,主要研究方向为粗糙集、不确定性分析及其应用.E-mail:dannylous@163.com.

吴哲,硕士,讲师,主要研究方向为图像处理、机器视觉、模式识别.E-mail:WUzhe33@hqu.edu.cn.

结合软覆盖与信息熵,提出软覆盖信息熵.定义软覆盖信息熵、软覆盖联合熵、软覆盖条件熵,并研究这些熵之间的关系及它们的重要性质.最后给出两种基于软覆盖条件熵的多属性群决策的算法,举例说明这两种算法的结果具有一致性.

HUANG Zhehuang,Ph.D., associate professor. His research interests include rough set and granular computing.

About Author:

WU Jiaming, master student. His research interests include rough set, uncertainty analysis and its application.

LI Jinjin, Ph.D., professor.His research interests include topology, rough set and concept lattice.

LIU Danyue, master student. Her research interests include rough set, uncertainty analysis and its application.

WU Zhe, master, lecturer. Her research interests include image processing, machine vision and pattern recognition.

Information entropy and soft coverings are combined to propose soft covering information entropy. Soft covering information entropy, soft covering joint entropy and soft covering conditional entropy are defined. The relationships between these entropies and their important properties are studied. Two kinds of algorithms for multi-attribute group decision making based on soft covering conditional entropy are presented, and the consistency between the results of these two algorithms is illustrated by examples.

本文责任编委 苗夺谦

Recommended by Associate Editor MIAO Duoqian

粗糙集理论[1, 2]是使用集合论处理某些不确定知识的数学方法.作为解决不确定性的一种工具, 粗糙集只使用内部知识, 而不依赖于先前的模型假设, 因此引起研究人员的广泛关注[3, 4, 5, 6, 7].但粗糙集需要在给定论域的元素之间产生等价关系, 在现实中这种等价关系很难得到.因此, 研究者们对粗糙集进行扩展, 包括邻域粗糙集[8]和基于覆盖的粗糙集[9, 10, 11].随后学者们发现基于覆盖的粗糙集理论的重要性并强调它的很多特征, 此理论越来越受到重视.陈应生等[12]在多尺度决策信息系统中, 把划分推广为覆盖, 并建立多尺度覆盖决策信息系统模型.

Molodtsov[13]提出软集理论, 这是另一种处理不确定性的数学工具.相比传统的数学工具, 软集理论最大的优势就是参数工具.软集理论可给出丰富的信息描述和计算操作, 因此, 在信息理论、决策分析、模式识别、数据挖掘中具有重要作用.Li等[14]结合软集和覆盖的概念, 提出软覆盖的概念和相关的参数约简.根据软粗糙集的思想, 研究人员将这些混合软集模型应用于决策, Feng等[5] 研究粗糙集和软集, 得出一些重要结论, 并建立基于软粗糙集的多准则群体决策.Zhan等[15]和Zhang等[16]提出基于粗糙集的软覆盖的邻域和补邻域, 并应用于多属性群决策.

信息熵是表征不确定性信息的有效工具, 熵及其变体的扩展已应用于粗糙集领域[17, 18, 19, 20, 21, 22].Liang等[23, 24]提出评价信息系统知识不确定性和模糊性的方法.陈东晓等[25]从信息粒角度提出基于信息熵研究形式背景的属性约简的方法.Lei等[26]定义平方粗糙熵, 用于度量图像的粗糙度, 并提出相应的图像阈值分割算法.还有一些研究者基于邻域系统, 建立信息熵及其变体, 并进行特征选择.Wang等[27]引入邻域可分辨矩阵的概念, 表征特征子集的分类能力, 并构造基于可辨性矩阵的特征评价函数.Sun等[28]基于模糊邻域多粒度粗糙集, 提出基于模糊神经网络的特征选择方法.Zhang等[29]使用基于模糊粗糙集的信息熵, 研究增量特征选择.但是, 目前尚未见到软覆盖与信息熵的融合研究.

本文以信息熵理论为基础, 结合软覆盖与信息熵, 提出软覆盖信息熵及其变体以及在多属性群决策中的应用.首先利用软覆盖定义5种类型的软覆盖信息熵并研究其性质, 再定义软覆盖联合熵、软覆盖条件熵.最后利用软覆盖条件熵进行多属性群决策, 并通过2种算法的对比发现结果具有一致性, 说明本文算法合理有效.

定义1[30]K=(G, B)为论域U上的软集, 其中, B⊆E, E为参数; G:B→ P(U), P(U)为U的幂集.序对P=(U, K)称为软近似空间.

定义2[30] 若(G, B)为论域U上的软集, 若

且∀ b∈ B, G(b)≠ Ø , 称(G, B)为软覆盖.

定义3[15] 令P=(U, CK)为U上的软覆盖近似空间, 对于∀ x∈ U, x的软邻域定义为

N

定义4[15] 令P=(U, CK)为U上的软覆盖近似空间, 对于∀ x∈ U, x的软补邻域定义为

N

结合软邻域和软补邻域, 可定义另外两种混合软邻域算子:

N

N

定义5[15] 令P=(U, CK)为U上的软覆盖近似空间, 对于∀ x∈ U, x的软粘连定义为

N

定义9 令N

其中, |· |表示集合的基数,

N

性质1 令N

0≤ H(N

证明 因为N

1≤ |N

所以

0≤ H(N

特别地, 对

∀ xi∈ U, |N

时,

H(N

对

∀ xi∈ U, |N

时,

H(N

性质2 令N

1)H(N

2)H(N

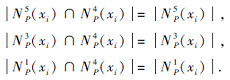

证明 先证1).由软邻域定义易知

N

故

|N

所以

H(N

再证2).同1)类似证明可得.

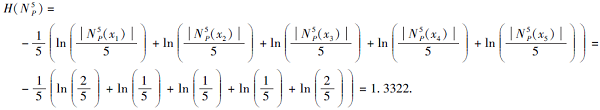

例1 学校足球队有5位学生报名, 记为U={x1, x2, …, x5}.社团的成员从5方面对这5位学生进行考核, 记为B={b1, b2, …, b5}, 这5方面分别是耐力、速度、力量、反应能力、团队精神, 这5人在5方面的特征可被记为一个软覆盖K=(G, B), 具体如表1所示.

| 表1 例1中学生的特征描述K=(G, B) Table 1 Students feature description K=(G, B) in example 1 |

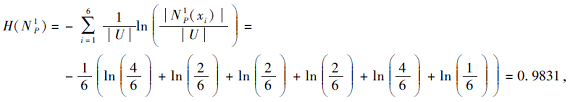

显然P=(U, CK)为U上的软覆盖近似空间, 则有

1)若r=1,

N

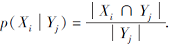

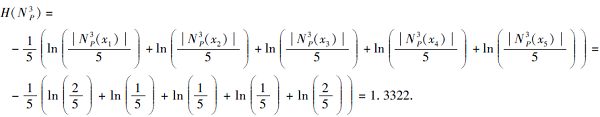

计算第一类软覆盖熵:

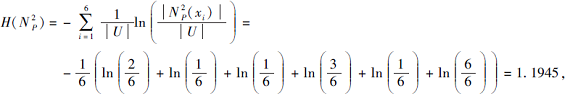

2)若r=2,

N

计算第二类软覆盖熵:

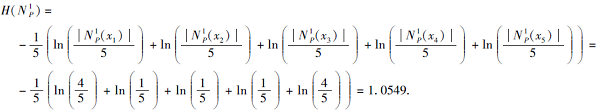

3)若r=3,

N

计算第三类软覆盖熵:

4)若r=4,

计算第四类软覆盖熵:

5)若r=5,

N

计算第五类软覆盖熵:

可看出例1符合性质2, 熵值越小说明其不确定性越小, 故对于软邻域N

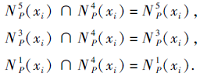

性质3 令N

H(N

证明

由于N

∀ xi∈ U, N

有

|N

则

因此可得

H(N

性质3表明软覆盖熵具有单调性.

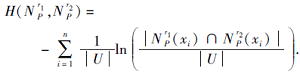

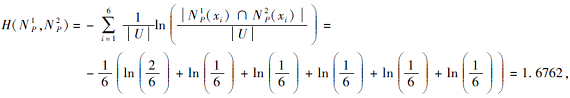

定义10 令N

性质4 令N

H(N

证明 对于∀ xi∈ U, 有

N

则

|N

所以

因此

H(N

同理可得

H(N

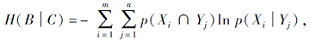

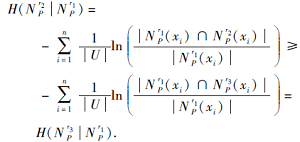

定义11 令N

软覆盖条件熵描述基于已知条件N

性质5 令N

1)若N

2)若N

H(N

证明 先证1).显然得证.

再证2).由于

N

故

情况1)表示若N

性质6 令N

1)H(N

2)H(N

证明 先证1).因为N

N

所以

从而

所以

因为

|N

所以

H(N

再证2).类似1)的证明可得.

例2 学校排球队有6位学生报名, 记为U={x1, x2, …, x6}.社团的成员从5方面对这6位学生进行考核, 记为B={b1, b2, …, b5}, 这5方面分别是耐力、速度、弹跳、反应能力、团队精神.6人在5方面的特征可被记为一个软覆盖K=(G, B), 具体如表2所示.

| 表2 例2中学生的特征描述K=(G, B) Table 2 Students feature description K=(G, B) in example 2 |

则有

软集模型在决策、综合评价、测度理论等领域都具有较广泛的应用.多属性的群决策是处理决策问题的有效方式, 它可让不同的专家在众多的候选者中做出不同的选择.在此基础上, 根据候选者的特点, 参照所有专家的意见寻找最佳的候选者方案, 如校队选人、学校招聘新教师等.在本文中, 利用软覆盖条件熵进行多属性的群决策.

令

Ii={Ii(x1), Ii(x2), …, Ii(xn)},

类似软覆盖条件熵, H(Ii|$N_{P}^{r}$)可用于表征$N_{P}^{r}$区分不同决策样本的能力.对于相同的

首先给出对U最初始的一个描述, 即软集K=(G, B), 如表3所示, 其中

B={b1, b2, …, bm}⊆E.

| 表3 候选人的特征描述K=(G, B) Table 3 Candidates feature description K=(G, B) |

例如在一个学校学生会招新成员的活动中, U表示应聘的所有人, B表示学生会应聘条件, b1表示性格, b2表示应变能力等.对于每个对象xi, i=1, 2, …, n, 属性bj, j=1, 2, …, m的值使用aij表示, aij∈ {0, 1}.显然应聘者和应聘条件构成一个软覆盖.假设I={I1, I2, …, Il}表示l位面试官, 对于每个对象xi, i=1, 2, …, n, Ik, k=1, 2, …, l, xi的值使用bik表示, bik∈ {0, 1}.

令K1=(M, I)为U上的软集, M(Ik)表示面试官Ik对于所有应聘者的选择.例如面试官Ik认为应聘者x1、x2可以胜任这个工作, 表示为M(Ik)={x1, x2}.Ik(xi)表示与xi分类相同的集合.例如, 面试官Ik认为应聘者x1、x2可以胜任这个工作, 反之x3、x4、x5、x6不胜任这个工作, 可记为

Ik(x1)={x1, x2}, Ik(x3)={x3, x4, x5, x6}.

记

Ik={Ik(x1), Ik(x2), …, Ik(xn)},

则面试官的选择K1=(M, I)如表4所示.

| 表4 面试官的选择K1=(M, I) Table 4 Interviewers choice K1=(M, I) |

首先给出U上的软覆盖K=(G, B), 软集K1=(M, I), 这里软覆盖是对U的描述, 软集是专家对于U的选择.根据软覆盖K=(G, B), 可计算每个xi∈ U的软邻域N

熵值越小表示专家的选择越优.

算法1 基于第一类软邻域多属性群决策算法

step 1 输入集合U, 软覆盖K=(G, B), 软覆盖近似空间(U, CK).

step 2 输入软集K1=(M, I), 表示专家组的评估结果.

step 3 由软覆盖K=(G, B)得出软邻域N

step 4 计算基于软覆盖近似空间(U, CK)的软覆盖条件熵H(Ii|N

step 5 找出最小值H(Ij|N

step 6 决策目标为Ij.

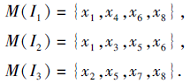

例3 一所学校要招募4名教师, 由3位面试官进行面试, 记为I={I1, I2, I3}.有7位应聘者参加面试, 记为U={x1, x2, …, x7}.B表示对7位应聘者的特征描述, 记为B={b1, b2, …, b5}, b1, b2, …, b5分别表示耐心、热情、学历、经验、应变能力.K=(G, B)是对于7位应聘者的特征描述, 如表5所示.表6为3位面试官I1、I2、I3的选择, 则

M(I1)={x1, x2, x4, x6}, M(I2)={x1, x2, x3, x7},

M(I3)={x2, x5, x6, x7}.

| 表5 例3中应聘者的特征描述K=(G, B) Table 5 Candidates feature description K=(G, B) in example 3 |

| 表6 例3中面试官的选择K1=(M, I) Table 6 Interviewers choice K1=(M, I) in example 3 |

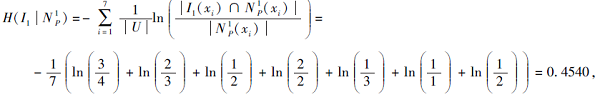

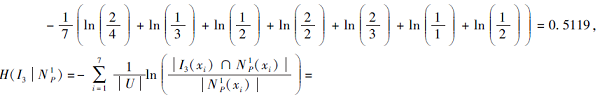

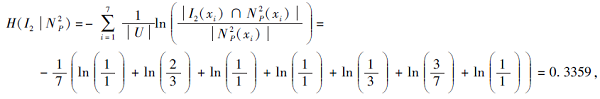

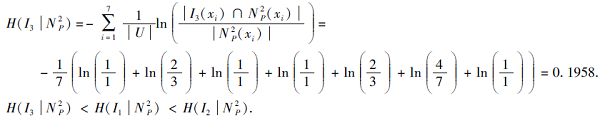

由此可得

N

N

I1(x1)=I1(x2)=I1(x4)=I1(x6)={x1, x2, x4, x6}, I1(x3)=I1(x5)=I1(x7)={x3, x5, x7}.

I2(x1)=I2(x2)=I2(x3)=I2(x7)={x1, x2, x3, x7}, I2(x4)=I2(x5)=I2(x6)={x4, x5, x6}.

I3(x2)=I3(x5)=I3(x6)=I3(x7)={x2, x5, x6, x7}, I3(x1)=I3(x3)=I3(x4)={x1, x3, x4}.

因此选择I3, 即x2、x5、x6、x7更能胜任这个工作.同时可认为面试官I3更公正合理, 更有能力担任面试这个工作.

算法2 基于第二类软邻域多属性群决策算法

step 1 输入集合U, 软覆盖K=(G, B), 软覆盖近似空间(U, CK).

step 2 输入软集K1=(M, I), 表示专家组的评估结果.

step 3 由软覆盖K=(G, B)得出软邻域N

step 4 计算基于软覆盖近似空间(U, CK)的软覆盖条件熵H(Ii|N

step 5 找出最小值H(Ij|N

step 6 决策目标为Ij.

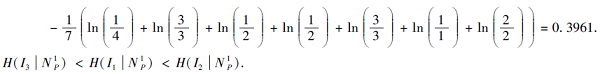

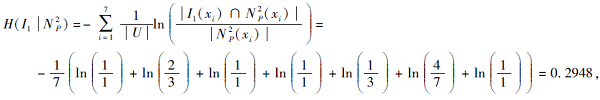

例4 由例3可得

N

N

I1(x1)=I1(x2)=I1(x4)=I1(x6)={x1, x2, x4, x6}, I1(x3)=I1(x5)=I1(x7)={x3, x5, x7}.

I2(x1)=I2(x2)=I2(x3)=I2(x7)={x1, x2, x3, x7}, I2(x4)=I2(x5)=I2(x6)={x4, x5, x6}.

I3(x2)=I3(x5)=I3(x6)=I3(x7)={x2, x5, x6, x7}, I3(x1)=I3(x3)=I3(x4)={x1, x3, x4}.

因此选择I3, 即x2、x5、x6、x7更能胜任这个工作.同时可认为面试官I3更公正合理, 更有能力担任面试这个工作.

由结论可发现, 上述两类软邻域的多属性群决策方式具有高度一致性, 均可得出面试官I3的决策优于面试官I1、I2的决策, 这说明上述决策合理可行.

对例3、例4使用不同类型的软覆盖条件熵的决策, 结果如表7所示.由表可看出, 无论r为多少, 得到的最优专家均为I3.同时还发现, 使用r=1, 2软覆盖条件熵的区别性更明显, 由此可见本文算法具有较高的一致性, 合理可行.

| 表7 例3和例4中使用不同软邻域的排序结果 Table 7 Sorting results using different soft neighborhoods in example 3 and example 4 |

下面进一步用实例对算法进行说明.

例5 一家公司要选择4名员工进行提拔, 现有8位候选人(以x1, x2, …, x8表示).B表示对8位候选人的特征描述, 记为

B={b1, b2, …, b5},

b1, b2, …, b5分别表示业绩、应变能力、热情、领导能力、工作经验.K=(G, B)是对于8位候选人的特征描述, 如表8所示.

| 表8 例5中应聘者的特征描述K=(G, B) Table 8 Candidates feature description K=(G, B) in example 5 |

3位主管对8位候选人进行选择, 如表9所示.3位主管I1, I2, I3的选择分别为

| 表9 例5中主管的选择K1=(M, I) Table 9 Superintend choice K1=(M, I) in example 5 |

使用不同软覆盖条件熵对例5进行决策, 决策结果如表10所示.由表可看出, 主管I1的选择更优, 即x1、x4、x6、x8更适合得到提拔的机会.同时可认为主管I1更公正合理, 有更好的判断力对员工进行提拔.

对5种类型的软覆盖条件熵的决策结果可看出, r=1, 2软覆盖条件熵区别性更明显.由于r=3, 5软邻域实际上是一种等价关系, 要求过于严格, 故得出的结果会较相近.而r=4软邻域的要求过于宽松, 故得出的结果也可能会较相近.因此使用r=1, 2软覆盖条件熵进行多属性群决策效果更优.

本文提出软覆盖信息熵、软覆盖联合熵、软覆盖条件熵的概念, 并研究它们的重要性质及关系.进一步结合软覆盖邻域算子与信息熵, 并推广到多属性群决策的环境下, 在此基础上, 认为r=1, 2软覆盖条件熵值得关注.提出2种基于软覆盖条件熵的算法, 并对2个示例进行充分研究, 经过对比发现, r=1, 2的决策结果区别性更明显, 所有类型的软覆盖条件熵模型的最优结果具有一致性, 由此说明本文决策方法合理可行.今后考虑将信息熵引入模糊信息系统中, 进一步探究在模糊信息系统下的群决策算法.

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|

| [13] |

|

| [14] |

|

| [15] |

|

| [16] |

|

| [17] |

|

| [18] |

|

| [19] |

|

| [20] |

|

| [21] |

|

| [22] |

|

| [23] |

|

| [24] |

|

| [25] |

|

| [26] |

|

| [27] |

|

| [28] |

|

| [29] |

|

| [30] |

|