袁 姮,博士,副教授.主要研究方向为图像处理、模式识别、人工智能.E-mail:slntuyuanheng@163.com.

作者简介:

于东琪,硕士研究生.主要研究方向为图像处理、模式识别、人工智能.E-mail:2459464905@qq.com.

高 原,硕士研究生.主要研究方向为图像处理、模式识别、人工智能.E-mail:1422822508@qq.com.

第二十七届中国科协年会学术论文

针对图像分类网络主要依赖空域特征、忽略频域特征的作用,从而导致性能提升受限的问题,文中提出面向图像分类的双域特征联合网络(Two-Domain Feature Association Networks for Image Classification, TANet).首先,设计频域特征提取模块(Frequency Domain Feature Extraction, FDFE),利用快速傅里叶变换有效捕捉图像中的频域细节信息及全局特征,减少关键特征流失,增强图像细节信息的表示能力,提高网络对图像特征的提取能力.再者,设计频域注意力机制模块(Frequency Domain Attention Mechanism, FDAM),考虑多尺度空域特征的同时结合快速傅里叶变换提取频域信息,加强对图像细节的敏感度,提高关键区域贡献度.然后,设计双域特征联合机制(Two-Domain Feature Association Mechanism, TFAM),融合频域特征与空域特征,在保证拥有空域特征的前提下,利用频域特征补充图像细节信息及全局特征,提升特征的表达能力.最后,在残差分支中嵌入FDAM,有效学习输入数据的双域特征,平衡局部信息与全局信息的关注度,增强关键特征的可利用性,提高网络的图像分类能力.在5个公共数据集上的实验表明,TUNet通过联合频域特征可提取图像细节信息及全局特征,减少关键特征流失,加强重要区域的感知能力,提高特征的表达能力,提升网络的图像分类性能.

YUAN Heng, Ph.D., associate professor. Her research interests include image processing, pattern recognition and artificial intelligence.

About Author:

YU Dongqi, Master student. His research interests include image processing, pattern recognition and artificial intelligence.

GAO Yuan, Master student. His research interests include image processing, pattern recognition and artificial intelligence.

Academic Papers of the 27th Annual Meeting of the China Association for Science and Technology

The performance improvement of image classification network is constrained due to the reliance on spatial domain features and the neglect of the role of frequency domain features. To address these issues, two-domain feature association networks for image classification(TANet) are proposed. First, a frequency domain feature extraction(FDFE) module is designed. The Fast Fourier Transform is employed to effectively capture the frequency domain detail information and global features in the image, reduce key feature loss, enhance the representation ability of image detail information, and improve the image features extraction ability of the network. Then, the frequency domain attention mechanism(FDAM) is proposed. The multi-scale spatial domain features are taken into account and combined with the Fast Fourier Transform to extract the frequency domain information. Through FDAM, the sensitivity to image details is enhanced, and the contribution of key regions is improved. Subsequently, a two-domain feature association mechanism(TFAM) is designed to fuse the frequency domain features with the spatial domain features. On the basis of retaining spatial domain features, the frequency domain features are utilized to supplement the image detail information as well as the global features and thereby enhance the expression ability of the features. Finally, FDAM is embedded into the residual branch to learn the two-domain features of the input data more effectively. Thus, the attention between local and global information is balanced, the availability of key features is enhanced, and the capability of the network in image classification is improved. Experiments on five public datasets show that TANet enhances the image classification performance of the network by incorporating frequency domain features, extracting image detail information and global features, reducing key feature loss, enhancing the perception of important regions, and improving the expression of features.

图像分类是计算机视觉领域的核心任务之一, 主要利用计算机视觉和机器学习技术, 对图像进行特征提取和识别, 实现对图像的自动分类[1].随着计算机视觉和深度学习技术的不断发展, 研究者们提出许多创新性方法以提升图像分类的精度和鲁棒性[2].

早期图像分类的主要方法是依赖人工设计的特征提取方法, 如边缘检测、纹理分析和颜色直方图等, 部分方法依赖特定领域的经验, 如小波变换、尺度不变特征变换和方向梯度直方图.尽管上述方法在实际应用中可有效进行图像分类, 但过度依赖特征选择的质量, 在较大图像上处理能力受限[3].随着计算需求和数据集规模的扩大, 深度学习方法性能大幅提升.Krizhevsky等[4]提出AlexNet, 通过多个卷积层与ReLU(Rectified Linear Unit)激活函数结合的方式逐步提取图像的局部特征, 并利用全连接层完成最终的分类任务, 相比传统方法, AlexNet可自适应学习数据中的重要特征, 提升分类性能.Simonyan等[5]提出VGG(Visual Geometry Group Net-work), 使用3× 3卷积及池化层堆叠, 提取图像中不同层次的特征, 并增加网络深度, 捕捉更复杂的图像特征, 图像识别能力较强.Szegedy等[6]提出深度卷积神经网络架构GoogLe-Net, 并行使用不同尺寸的卷积核和池化操作, 在同层内提取多尺度的特征, 提高网络的表现力和计算效率.

随着网络层数的不断加深, 会出现梯度消失和梯度爆炸等问题.为了解决上述问题, He等[7]提出ResNet(Residual Network), 引入残差连接(Residual Connections), 使信息能在网络中跨层传播, 减轻网络深度增加时的训练困难, 大幅提升深度神经网络的可训练性和分类性能.Zagoruyko等[8]提出WRN(Wide Residual Network), 增加卷积层中卷积核数量以增加网络宽度, 减少训练时间, 提高对输入数据的表示能力, 改善网络性能.Xie等[9]提出ResNeXt, 将每层的卷积操作分成多个并行分支, 每个分支包含少量的卷积核, 最终合并分支结果.这种设计在保证计算效率的同时, 可显著提高网络的分类性能.Gao等[10]提出Res2Net, 在每个残差块内部引入不同尺度的卷积操作, 捕捉丰富的层次信息, 提高网络在捕获多尺度信息方面的能力.

值得注意的是, 上述残差网络作为逐层优化的网络架构, 处理长距离依赖关系的能力较弱, 无法充分提取图像特征, 产生特征冗余, 全局上下文建模能力不足.为了解决上述问题, Li等[11]提出SKNet(Selective Kernel Network), 设计核心模块SKAtten-tion, 动态选择不同尺度的卷积核, 在不同的输入图像区域和任务中自适应调整特征的表达方式.与传统方法固定使用某一特定尺度的卷积核不同, SKNet在网络运行过程中通过注意力机制, 根据不同的输入特征自动选择合适的卷积核尺度, 增强网络对图像的感知能力.Shen等[12]提出Efficient Attention, 通过近似计算、稀疏化注意力和低秩分解等技术将计算复杂度降至线性或接近线性, 使网络能处理长序列数据或大规模数据, 同时保留捕捉长程依赖和全局信息的能力.Lin等[13]提出CAT(Cross Attention Transformer), 计算查询(Query)与键(Key)之间的相似度, 再加入权值(Value), 在多个模态之间建立信息的动态关联, 跨越不同输入域(如文本与图像), 使网络能灵活结合多模态信息.Sun等[14]提出MSCA-Net(Multi-scale Contextual Atten-tion Network), 通过并行的全局-局部方式, 应用通道关注和空间关注捕获全局上下文信息, 尤其是在具有多种尺度信息的任务(如目标检测和图像分割)中, 结合不同尺度的信息, 增强对重要区域的关注.Ouyang等[15]提出EMA(Efficient Multi-scale Atten-tion), 保留每个通道上的信息, 将通道维度划分为多个子特征, 使空间语义特征在每个特征组内均匀分布, 除了对全局信息进行编码以重新校准每个并行分支的通道权重以外, 还通过跨维交互方法进一步聚合两个并行分支的输出特征.

此外, Transformer架构为图像分类提供新的研究方向.Khan等[16]提出ViT(Vision Transformer), 首次将Transformer引入图像分类领域, 将图像分割为序列化的图像块并输入Transformer编码器, 利用自注意力机制有效捕捉图像的长程依赖关系.Touvron等[17]提出DeiT(Data-Efficient Image Transformers), 引入知识蒸馏策略, 显著降低网络对大规模训练数据的依赖.Liu等[18]提出Swin Transformer, 采用分层窗口注意力机制, 保持全局建模能力的同时大幅降低计算开销, 高效处理高分辨率图像.

目前图像分类技术以深度学习中卷积神经网络和基于Transformer的模型为主导, 应用大规模预训练模型、自监督学习和对比学习等方法, 减少对标注数据的依赖, 提高在小规模数据集上的图像分类能力, 而且上述网络均应用注意力机制, 可提高特征提取能力, 增强图像分类能力.但是, 它们主要依赖空域特征进行图像分类, 忽视频域特征对于图像分类网络的重要性[19].

频域特征能揭示图像中不同频率成分的分布, 尤其是高频成分, 包含图像边缘、纹理等细节信息, 有助于提升图像特征的表达能力.因此本文提出面向图像分类的双域特征联合网络(Two-Domain Feature Association Networks for Image Classification, TANet).首先, 设计频域特征提取模块(Frequency Domain Feature Extraction, FDFE), 提取图像细节信息及全局特征, 减少关键特征流失, 增强图像细节信息的表示能力.然后, 设计频域注意力机制模块(Frequency Domain Attention Mechanism, FDAM), 结合FDFE与SKAttention, 加强对图像细节的敏感度, 提高关键区域贡献度.最后, 提出双域特征联合机制(Two-Domain Feature Association Mechanism, TFAM), 联合空域特征与频域特征, 保持空域特征提取的同时, 利用频域特征补充图像细节信息及全局特征, 提升特征的表达能力.

相比注重局部像素空间分析的空域特征方法, 频域特征方法通过频率分析得到图像特征, 通过表示图像中各个频率成分的强度和分布情况, 揭示图像的全局特征、边缘、纹理和周期性结构.利用频域特征能抑制图像中的高频噪声影响, 学习图像的全局结构信息, 提高图像细节信息的表达能力.如果网络在保证空域特征提取的同时, 通过提取频域特征可强化图像特征提取能力, 提升特征表达能力和图像分类性能.依照上述思想并验证频域特征对图像分类网络的重要性和频域特征与空域特征联合对提升图像分类网络性能的有效性, 本文提出面向图像分类的双域特征联合网络(TANet), 整体架构如图1所示.

TANet主要由预处理模块、浅层特征提取层、双域特征联合机制(TFAM)、频域注意力机制模块(FDAM)及分类输出层组成.

TANet共有如下4个训练阶段.

1)预处理阶段.应用Cutout数据增强技术对输入图像进行预处理, 随机遮掩一个区域或多个区域, 提高网络的鲁棒性, 降低过拟合风险, 并通过增加训练数据的多样性, 使网络更具适应性, 更好地应对复杂场景和噪声干扰.

2)浅层特征提取阶段.将预处理后的图像输入3× 3卷积层或7× 7卷积层.默认卷积核尺寸为7× 7, 当网络处理小尺寸数据集时, 使用3× 3卷积, 并去除最大池化操作, 提取浅层特征.

3)深层特征提取阶段.引入TFAM, 通过多个TFAM(Layer1、Layer2、Layer3、Layer4)逐层提取更复杂的特征.在残差分支中应用FDAM, 提高特征提取能力, 增强特征的表达能力.

4)分类输出与整合.数据经过平均池化处理之后, 将特征展平成一维向量, 通过全连接层生成最终分类结果.最后采用交叉熵损失(Cross Entropy Loss)衡量网络预测的概率分布与真实标签之间的差异, 并优化训练过程, 准确学习分类任务中的类别边界, 提升分类性能.

为了实现后续双域特征的融合, 增强网络对图像中细微特征和频域信息的捕捉能力, 保留较完整的图像结构, 本文提出频域特征提取模块(FDFE).FDFE在网络提取局部信息的同时, 提取频域信息, 利用频域特征的尺度和旋转不变性, 进一步优化图像特征, 并通过快速傅里叶变换(Fast Fourier Trans-form, FFT)的去噪作用, 在细节特征提取过程中免受噪声干扰, 减少关键特征流失, 增强图像细节信息的提取能力.

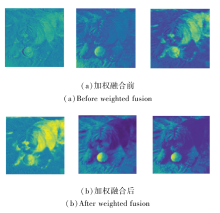

FDFE结构如图2所示.为了便于观察, 本文将幅度输出设为以红色和黄色为主的色彩图, 相位输出设为以蓝色为主的色彩图.

FDFE首先对原特征图像进行3× 3卷积操作, 并利用跳跃连接进一步保留输入信息的特征, 减少图像特征的丢失, 这有利于FDFE后续的频域信息重构.卷积后输出特征图像尺寸为:

B=

其中, C表示输入特征图像尺寸, K表示卷积核尺寸, P表示填充大小, L表示卷积步长.

再应用ReLU激活函数, 增强训练过程的稳定性, 学习非线性特征.ReLU激活函数表示为

ReLU(x)=max(0, x).

其中:x表示输入值, 本文中为图像数据; max(0, x)表示对于输入值x, 将负值部分映射为0, 正值保持不变.

然后对特征图进行FFT, 将图像转换到频域, 捕捉图像的周期性结构、高频特征及整体结构信息.定义输入特征图像为x, 则频域坐标为(u, v)时经过FFT后的频域结果如下:

$\begin{aligned} F F T(\boldsymbol{x})= & \frac{1}{M N} \sum_{x=0}^{M-1} \sum_{y=0}^{N-1}(f(x, y) \\ & \left.\exp \left(-\mathrm{i} \frac{2 \pi}{M} u x\right) \exp \left(-\mathrm{i} \frac{2 \pi}{N} v y\right)\right) \end{aligned}$

其中: f(x, y)表示输入图像的像素值, 位于空域中的坐标(x, y); $ \exp \left(-\mathrm{i} \frac{2 \pi}{M} u x\right) \exp \left(-\mathrm{i} \frac{2 \pi}{N} v y\right)$表示FFT的复指数项, 在频域中计算特定频率成分; i表示虚数单位; M、N表示输入图像的高度和宽度, 分别为f(x, y)的行数和列数.

FFT作为傅里叶变换的高效实现, 能降低傅里叶变换的计算复杂度, 方便提取图像的频域特征, 尤其是低频信息, 并且FFT具有去噪和强化图像特征的作用.因此本文采用FFT处理图像, 提取全局特征、周期性结构、纹理信息与细节信息.

将特征图像转入频域之后, 在第一个分支中, FDFE对输入特征进行幅度提取, 为网络提供图像纹理信息和周期性结构, 并减少噪声和冗余信息对特征提取的影响.频域特征的幅度反映某一频率分量的强度, 具体公式如下:

FD(x)=

其中, FFT(x)表示FFT后的频域结果, Re(FFT(x))表示FFT(x)的实部, Im(FFT(x))表示FFT(x)的虚部.

然后, 对提取的幅度值应用ReLU激活函数, 消除FFT过程中引入的负幅度值, 只保留有效的频域成分, 使网络的训练过程更稳定.

在第二个分支中, FDFE对输入特征进行相位提取.相位信息能帮助网络理解图像中物体位置、边缘和轮廓等, 增强对图像的几何形状和结构信息的感知.相位表示FFT中复数频率成分的角度信息, 反映不同频率成分在图像中出现的空间位置或方向, 具体公式如下:

$\operatorname{Angle}(\boldsymbol{x})=\arctan \left(\frac{\operatorname{Im}(F F T(\boldsymbol{x}))}{\operatorname{Re}(F F T(\boldsymbol{x}))}\right)$,

其中, arctan(· )表示反正切函数, 用于计算相位角.

相比仅依赖幅度, 保留相位信息有助于捕捉更细致的空间结构变化, 所以FDFE重新组合相位信息与幅度信息, 重构后的频域特征如下:

Frec=REC(x)=FD(x)exp(i· Angle(FFT(x))),

其中, REC(x)表示重构, Angle(FFT(x))表示频域数据的相位信息, FD(x)表示频域数据的幅度, exp(i· Angle(FFT(x)))表示复指数形式的相位信息, 用于保持频域数据的相位.

结合幅度与相位, 网络能更准确地重构图像中的重要结构、纹理和细节, 共同构成图像的特征信息, 增强网络对特征的表示能力.最后, 对重构后的频域数据执行逆快速傅里叶变换(Inverse FFT, IFFT), 减少噪声干扰, 确保特征图像在保持频域信息的同时, 转换为空域的形式, 提高网络对频域特征的表达能力, 有助于后续空域特征与频域特征的融合.IFFT具体公式如下:

$\begin{aligned}\operatorname{IFFT}(\boldsymbol{x})= & \frac{1}{M N} \sum_{u=0}^{M-1} \sum_{v=0}^{N-1}\left(F_{\text {rec }} \cdot\right. \\& \left.\exp \left(\mathrm{i} \frac{2 \pi}{M} u x\right) \exp \left(\mathrm{i} \frac{2 \pi}{N} v y\right)\right), \end{aligned}$

其中, $ \exp \left(\mathrm{i} \frac{2 \pi}{M} u x\right), \exp \left(\mathrm{i} \frac{2 \pi}{N} v y\right)$表示IFFT中的复指数项, 用于将频域数据转换回空域, M、N表示图像的高度和宽度.

综上所述, FDFE可有效整合频域信息, 增强网络对图像中细微特征和频域信息的捕捉能力, 提升特征细节信息的表达能力, 并利用FFT的去噪作用, 减少噪声对特征提取的干扰, 增强对图像的特征感知能力, 有效提高网络的提取能力.FDFE最后还会将提取的频域特征转为空域形式, 便于后续构建双域特征联合机制.

图像的不同部分包含不同尺度的细节和上下文信息, 卷积神经网络无法充分利用图像中的长程依赖关系和跨尺度特征提取多尺度特征, 导致细节信息的流失.

受SKNet[11]的启发, 本文结合FDFE与SKNet中的SKAttention, 提出频域注意力机制模块(FDAM).结构如图3所示.FDAM主要由三部分组成:多尺度卷积特征提取、FDFE和自适应加权融合机制.

FDAM在考虑提取特征的同时, 关注通道维度的适应性, 提高不同场景和图像条件适应性, 并且通过FDFE中的频域处理, 为多尺度特征提供更多的处理空间, 加强对图像细节的敏感度, 提高关键区域贡献度, 有效捕捉图像的高频细节和纹理信息.

FDAM首先进行多尺度卷积特征提取, 其中, 大尺度的卷积能为小尺度的细节提供上下文信息, 帮助网络更好地理解细节背后的结构关系.图3以马的图像作为输入特征图进行举例, 假设输入特征图像x∈ RC× H× W, 其中, C表示通道数, H表示高度, W表示宽度.每个卷积操作表示为

yi=convi(x)=Conv2d(x, ki),

其中, i表示每个尺度的卷积操作和相应的处理步骤, ki∈ {1, 3, 5, 7}表示卷积核的尺寸, Conv2d(· , · )表示二维卷积, convi(· )表示应用不同大小卷积核后生成的特征图.多个卷积核产生的相应多尺度特征为{y1, y3, y5, y7}.

然后, 通过FDFE, 每个尺度的卷积特征图捕捉更多的全局信息、边缘信息、纹理信息和周期性结构, 紧密联通上下文信息, 适应不同尺寸和不同结构的图像.对于第 i 个尺度的卷积输出yi, yi经过FDFE后得到的输出特征:

Fi=FDFE(yi).

经过FDFE处理后多个尺度特征图表示为

F={F1, F3, F5, F7},

将Fi进行求和:

U=

对U进行全局平均池化(Global Average Poo-ling, GAP), 得到每个特征图的全局信息:

S=GAP(U)=

用于生成信道方式的统计数据.

此外, 通过全连接层(Fully Connected Layer, FC)创建生成每个尺度的通道描述符:

Z=FC(S).

计算所有全连接层变换, 归一化(Softmax)后得到第k个卷积核的注意力权重

wtsk=FCk(Z)

和第k个卷积核归一化后的注意力权重

ask=Softmax(wtsk).

最后按注意力权重动态选择特征, 利用全连接层生成的注意力权重Z引导网络关注图像中最相关的尺度特征, 并加权求和, 有效减少信息冗余, 得到最终加权的特征输出:

V=

综上所述, FDAM对每个卷积特征进行频域处理, 提升对不同尺度特征的处理能力, 在考虑图像中的长程依赖关系的同时, 利用FDFE细节信息的捕捉能力, 增强细节特征的表示能力, 提高关键区域贡献度, 帮助网络学习关键特征.

ResNet-34中的常规残差模块主要通过卷积操作捕捉图像的局部空间结构, 单纯提取空域特征不足以充分表示图像的细节信息及全局特征, 导致信息丢失, 网络无法更好地学习图像.

为了解决这一问题, 本文提出双域特征联合机制(TFAM), 替换网络中的常规残差模块.TFAM结构如图4所示.

TFAM通过频域特征与空域特征的加权融合, 在保持空域特征提取的同时, 利用频域特征捕捉图像的全局特征、边缘特征、纹理特征和周期性结构, 有效补充图像的细节信息及全局信息, 提升网络的分类性能.

在第一分支中, TFAM对空域特征的提取步骤与常规残差块的初步提取步骤相同, 特征图在经过两层3× 3卷积后得到空域特征, 即

E=BN(conv(ReLU(BN(Conv2d(x, 3))), 3)),

其中BN(· )表示批量归一化层.

在第二分支中, TFAM引入FDFE提取频域特征F, F作为空域形式的频域特征, 直接对其进行归一化处理, 确保不同尺度的特征在相同的数值范围内进行有效融合, 避免数值差异过大导致训练不稳定.归一化之后的频域特征为:

NM=Norm(x)=

其中, F表示获取的频域特征, Norm(x)表示对F进行归一化处理, max(· )表示当前批次中频域特征最大值.min(· )表示当前批次中频域特征最小值.

之后将归一化后频域特征与空域特征进行加权权融合, 输出

T=α E+(1-α )NM,

其中, α 表示空域特征加权系数占比, 控制空域特征与频域特征的融合程度.在TANet中, α 设为0.4, 频域特征在融合后的特征图中占主导地位, 而空域特征在加权融合中占比较小, 由此表明频域特征对图像分类的重要性.

加权融合前后特征图像对比如图5所示.

网络在拥有空域特征的基础上, 利用频域特征捕捉全局信息及细节信息, 可提高特征表示能力.由图5可见, (b)中的特征图比(a)中的更清晰, 图像特征表达更明显.

加权融合的特征图像经过残差连接与输入图像相加, 进一步加强网络对图像特征的学习能力, 并且残差连接的引入可有效避免深度神经网络中的梯度消失问题, 促进特征信息的传递, 以便训练更深层次的网络, 有效挖掘图像中的复杂特征.

最后, 输出的特征图像通过ReLU激活函数进行非线性转换, 增加网络的非线性表达能力, 并为后续的网络层提供更丰富的特征信息.

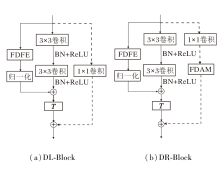

随着网络层数的增加, 可通过TFAM中的残差连接缓解梯度消失或梯度爆炸问题, 但随着网络加深, 信息在层与层之间的传递效率逐渐降低, 网络容易学习冗余的特征, 导致重要信息的聚焦能力不足.为了解决这个问题, 提升关键特征的聚焦能力, 本文将FDAM嵌入TFAM的残差分支中, 嵌入FDAM后的TFAM(简记为DR-Block)结构与嵌入前的降维TFAM(简记为DL-Block)对比如图6所示.

图6(a)为DL-Block, 由TFAM和残差分支组成, 残差分支中采用1× 1卷积降维.(b)为DR-Block, 由TFAM和残差分支组成, 残差分支包含1× 1卷积降维和FDAM, DR-Block在避免梯度消失或梯度爆炸的同时, 通过加权融合多尺度特征, 有效学习输入数据的双域特征, 增强关键特征的可利用性, 提升网络在图像分类任务中的性能.

嵌入FDAM前待拟合对象:

H(x)=C(x)+x,

其中, C(x)表示TFAM的残差函数, x表示输入特征图像.

嵌入FDAM后待拟合对象:

Z(x)=C(x)+FR(x),

其中FR(x)表示经过FDAM后的x.

综上所述, TFAM通过融合FDAM优化残差映射, 弥补空域卷积的局限性, 避免梯度消失或梯度爆炸的问题, 并通过FDAM的自适应加权机制平衡局部信息与全局信息的关注度, 为网络提供更多的细节信息, 提高网络的图像分类性能.

本文实验采用Python语言和Pytorch框架进行网络搭建, 操作系统采用Windows11系统, GPU采用NVIDIA RTX 4090显卡, 显存容量24 GB.

为了评估TANet的性能, 选择CIFAR-10、CI-FAR-100、SVHN、Imagenette、Imagewoof数据集作为实验数据集, 数据集信息如表1所示.

| 表1 实验数据集 Table 1 Experimental datasets |

训练总周期设为200, 初始学习率设为0.1, 在迭代次数分别为60, 120, 160时将学习率缩减为原来的1/5, 采用随机梯度下降(Stochastic Gradient Descent, SGD)优化器.在CIFAR-10、CIFAR-100、SVHN数据集上批次大小为128, 在Imagenette、Ima- gewoof数据集上批次大小为64.

实验均在数据增强后的数据集上进行, 采用图像分类常用指标— — 分类准确率(Accuracy, Acc)作为评价指标.

2.2.1 频域注意力机制模块的嵌入位置及数量

以ResNet-34为基础, 将网络中所有残差模块替换为双域特征联合机制(TFAM), 网络主干分为4个Layer, 在4个Layer之间有3个降维双域特征联合机制(简记为DL-Block).DL-Block引入残差连接, 使网络训练更稳定, 更深入挖掘数据中的特征, 避免深度神经网络训练过程中的梯度消失或梯度爆炸问题.

由于在残差连接之前使用注意力机制会导致一些关键特征的损失, 因此为了减少这种特征丢失并增强网络对不同尺度的特征响应, 在残差连接中嵌入融合FDAM的双域特征联合机制(简记为DR-Block).FDAM通过选取大量特征中最具代表性的部分, 保留关键特征, 防止在降维过程中造成信息丢失, 并引入FDFE平衡局部信息与全局信息的关注度, 增强重要特征的可利用性.

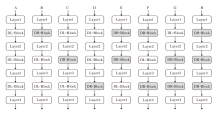

为了研究DR-Block嵌入位置与数量对网络性能的影响, 并保证实验准确性, 设计8种排列组合方式, 具体如图7所示.

通过在不同位置和不同数量的残差连接处引入DR-Block, 研究DR-Block位置及数量的变化对网络性能的影响, 有助于找出最佳的结构配置, 提高网络的分类性能.

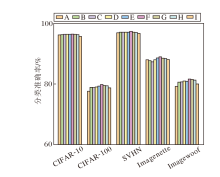

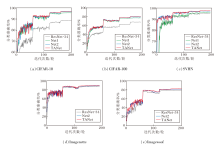

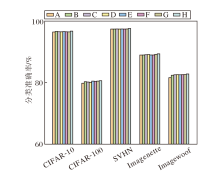

嵌入DR-Block的8种组合方式在5个数据集上的分类准确率如图8所示.由图可知, 组合方式H在CIFAR-10、CIFAR-100、SVHN、Imagenette、Image-woof数据集上分别取得96.34%、79.46%、97.35%、88.22%、81.41%的分类准确率, 均高于其它组合方式, 由此证实嵌入DR-Block的最佳方式是H, 在3个残差连接中都使用DR-Block.

| 图8 DR-Block的8种排列组合方式对分类准确率的影响Fig.8 Effect of 8 arrangement and combination schemas of DR-Block on classification accuracy |

实验表明在3个降维双域特征联合机制中嵌入FDAM, 在避免因梯度消失或梯度爆炸导致性能下降的同时, 可充分利用图像的多尺度特征, 增强网络对关键区域的响应能力, 减少特征信息的丢失, 优化特征提取和传递的过程, 进一步提升网络对细节信息的敏感度, 增强网络对局部信息和全局信息的平衡处理能力, 提高分类性能.

2.2.2 双域特征联合机制的加权系数

在图像分类任务中, 空域特征直接反映图像的空间信息, 捕捉局部特征与结构信息, 而频域特征通过对图像进行变换, 揭示图像的全局模式和频率信息, 有效描述图像的整体形态和纹理细节.

TFAM联合这两类特征, 充分利用二者在信息表达上的互补性, 提升网络分类性能.在实际应用中, 加权系数的选择与融合特征的效果存在必然联系.选择合适的加权系数会对网络性能具有巨大的提升作用, 但不适合的系数会导致性能下降, 甚至增加系统的计算负担.

为了深入探究TFAM中的加权系数对图像分类性能的影响, 设置如下9组不同的空域特征和频域特征加权比例方案:方案A(0.9∶ 0.1)、方案B(0.8∶ 0.2)、方案C(0.7∶ 0.3)、方案D(0.6∶ 0.4)、方案E(0.5∶ 0.5)、方案F(0.4∶ 0.6)、方案G(0.3∶ 0.7)、方案H(0.2∶ 0.8)和方案I(0.1∶ 0.9).

使用9种方案, 分别在CIFAR-100、CIFAR-10、SVHN、Imagenette、Imagewoof数据集进行训练和测试, 获得的分类准确率如图9所示.

由图9可见, 简单的增大或减小加权系数并不一定取得最佳的分类效果.由方案A与方案I可知, 当空域特征或频域特征的占比过大时, 会导致信息融合的失衡, 网络无法充分利用空域和频域的互补优势, 并会让某一方面的特征主导整个学习过程, 性能反而下降.过度依赖频域特征或空域特征会导致网络在一类特征上过拟合, 如果频域特征被过度加权, 网络会在具有频域特征优势的类别上表现良好, 但在具有空域特征优势的类别中表现不佳.

综上所述, 方案F(空域特征与频域特征占比为0.4∶ 0.6)在CIFAR-10、CIFAR-100、SVHN、Image-nette、Imagewoof数据集上分别取得96.47%、79.83%、97.41%、88.96%、81.63%的分类准确率, 均为最高值.由此说明在空域特征与频域特征的加权融合中, 适当的比例能平衡两种特征的优势, 当加权系数为0.4时, 网络能充分利用空域特征的局部信息和频域特征的全局特征、细节信息, 优化特征表达能力, 保持细节敏感性, 提高泛化能力和分类性能.

2.2.3 网络层数

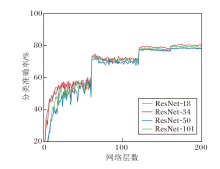

为了确保基线模型的合理性, 并且适应图像数据的复杂性, 本文选用如下4种主流的网络模型进行测试:ResNet-18、ResNet-34、ResNet-50、ResNet-101.将TFAM与FDAM共同加入这4种网络中, 并使用相同的实验环境及实验参数进行测试, 在CIFAR-100数据集上进行训练, 具体分类准确率如图10所示.

由图10可见, ResNet-34的分类准确率为80.64%, 分别比ResNet-18、ResNet-50、ResNet-101提升2.03%、2.24%、1.14%.相比ResNet-18, ResNet-34能通过更深的网络结构捕捉更多的高层次特征.ResNet-50和ResNet-101的网络层数深于ResNet-34, 但分类准确率却低于ResNet-34, 这说明网络层数的增加, 不代表分类性能的提升.深层网络具有更多的参数和更高的表达能力, 但也会带来更复杂的计算过程和更多的冗余特征, 导致信息的冗余传递和梯度消失等问题, 从而抑制其性能的提升.

综上所述, 适中的网络深度与TFAM和FDAM的结合可更好地提升网络的分类性能.ResNet-34在实验中的表现优于其它深度网络, 并且ResNet-34在避免学习冗余特征的同时, 能充分利用TFAM和FDAM的优势提高分类性能, 由此证实ResNet-34作为基线模型, 比其它层数网络更适合应用在TFAM与FDAM上.

在进行注意力机制的分类能力对比实验之前, 本文首先在CIFAR-100数据集上进行5种注意力机制的参数量与计算量的对比实验.取通道数为64时残差模块的残差分支产生的参数量作为对比标准, 计算量对比以网络运行一轮时间为衡量标准.选取如下5种注意力机制:SK-Attention[11]、SE(Squeeze-and-Excitation Networks)[20]、ECA(Efficient Channel Attention)[21]、 CA(Coordinate Attention)[22]、CBAM(Convolutional Block Attention Module)[23].实验中将5种注意力机制分别插入ResNet-34中, 与FDAM嵌入位置相同, 具体结果如表2所示.

| 表2 各注意力机制的参数量与计算量 Table 2 Number of parameters and computational cost of different attention mechanisms |

为了进一步验证FDAM对网络图像分类性能提升的有效性, 选取上述5种注意力机制与FDAM进行对比实验.实验操作与上述操作一致, 并分别在CIFAR-10、CIFAR-100、SVHN、Imagenette、Imagewoof数据集上进行训练, 具体分类准确率如表3所示.

| 表3 不同注意力机制对分类准确率的影响 Table 3 Effect of different attention mechanisms on classification accuracy % |

由表3可知, FDAM在5个数据集上的分类准确率最优.对比的5种注意力机制主要依赖通道和空间域的注意力增强特征表示, 未充分考虑图像的频域信息.SKAttention自适应选择不同尺度的卷积核, 捕捉不同尺度的特征, 增强多尺度信息的表达, 主要聚焦于尺度选择和空域特征的增强, 效果在不同类型的图像上存在差异.

FDAM通过FDFE引入频域特征, 减少关键特征流失, 增强图像细节信息的表示能力, 提高网络对图像特征的提取能力, 更好地关注图像的全局特征和细节信息, 增强多尺度特征的响应, 提高对关键区域的关注度.

分析表2和表3可知, 在网络架构中引入FDAM会增加一定的计算复杂度, 但其对网络分类性能的提升效果显著优于额外引入的计算开销.因此, 在网络中引入FDAM是一种有效方法, 能在不显著增加计算负担的情况下, 有效提升图像分类网络的整体性能.

为了验证TFAM和FDAM对于图像分类网络性能提升的有效性, 在CIFAR-100、CIFAR-10、SVHN、Imagenette、Imagewoof数据集上进行消融实验.

设计如下网络:1)ResNet-34.2)Net1.ResNet-34在CIFAR-100、CIFAR-10、SVHN数据集上处理图像时浅层提取阶段的首层卷积核大小改为3× 3, 同时去除最大池化操作, 在Imagenette、Imagewoof数据集上不变.3)Net2.在Net1基础上将所有残差模块替换为TFAM.4)TANet.在Net2基础上加入FDAM.

各网络的消融实验结果如表4所示, 由表可知, 分类准确率由高到低依次为TANet, Net2, Net1, ResNet-34.

| 表4 TANet的消融实验结果 Table 4 Ablation experiment results of TANet % |

各网络在5个数据集上的分类准确率曲线如图11所示.由表4和图11可知, 相比ResNet-34, Net1修改浅层提取阶段中的操作, 有效减少图像原始信息的丢失, 提升网络在小尺寸数据集上的图像分类能力.Net2在5个数据集上的图像分类准确率都有所提升, TFAM首先利用FDFE捕捉图像中的频域细节信息及全局特征, 减少关键特征在提取过程中流失, 增强图像细节信息的表示能力, 提高网络对图像特征的提取能力, 再加权融合空域特征与频域特征, 保证拥有空域特征的前提下, 利用频域特征补充图像细节信息及全局特征, 增强图像的特征表示能力, 提高图像分类性能.

相比Net2, TANet在5个数据集上的图像分类性能都有所提升, 表明FDAM可加强网络对全局特征与局部特征的捕捉能力, 帮助网络学习关键特征, 提高关键区域的贡献度.FDAM嵌入残差分支中, 可有效进行多尺度的特征提取, 增强细节特征, 平衡局部信息与全局信息的关注度, 增强重要特征的可利用性.

消融实验表明, 无论是在小尺寸还是大尺寸、分类类别较少还是分类类别较多的数据集上, TFAM和FDAM均能对网络的图像分类性能起到提升作用, 并且TFAM和FDAM结合使用, 对网络分类性能的提升效果最佳.

为了验证TANet的有效性, 选择如下10种常见的图像分类网络:ResNet-34、WideResNet-28-10[8]、EfficientNets[24]、Ghost-Net[25]、DenseNet(Dense Convolutional Network)[26]、QKFormer[27]、Couplformer[28]、TA-DFKD(Teacher-Agnostic Data-Free Knowledge Distillation)[29]、MMA-CCT-7/3× 2[30]、AugLocal[31]、FAVOR+(Fast Attention via Positive Orthogonal Ran-dom Features Approach)[32]、SimpNet[33]、GAC-SNN[34]、ATO(Auto-Train-Once)[35].上述网络在CIFAR-10、CIFAR-100、SVHN、Imagenette、Imagewoof数据集上进行对比实验.

本文对比实验的数据来源如下:首先, 对于未开源的代码, 优先采用对比网络对应论文提供的实验结果; 其次, 通过使用论文提供的开源代码进行复现实验.

各网络在5个数据集上的分类准确率对比如表5所示.由表可见, TANet 在5个数据集上的分类准确率最高, 说明其具有最优识别效果.

| 表5 各网络在5个数据集上的分类准确率 Table 5 Classification accuracies of different networks on 5 datasets % |

为了进一步展示 TANet对于图像分类性能提升的有效性, 图12列出ResNet-34和TANet在大小为32× 32的CIFAR-10数据集和大小为224× 224的Imagewoof数据集上的分类混淆矩阵, 数据集上各类的正确样本数量与错误样本数量如图所示.

| 图12 ResNet-34和TANet在2个数据集上的分类混淆矩阵Fig.12 Classification confusion matrices of ResNet-34 and TANet on 2 datasets |

由图12可见, 相比ResNet-34, TANet在CIFAR-10、Imagewoof数据集上拥有更多的正确样本数量和更少的错误样本数量.

实验表明, TANet利用TFAM和FDAM, 可有效减少关键特征流失, 增强图像细节信息的表示能力, 提高关键区域的贡献度, 平衡局部信息与全局信息的关注度, 增强关键特征的可利用性, 提高网络对图像特征的表示能力, 进而增强图像分类性能.实验同时验证频域特征对图像分类网络的重要性和双域特征联合对提升图像分类网络性能的有效性.

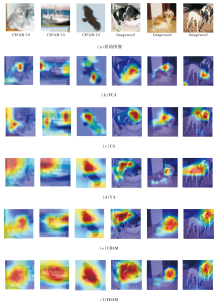

为了进一步说明FDAM在特征提取方面的效果, 选择如下注意力机制进行对比:CA[22]、CBAM[23]、FCA(Frequency Channel Attention)[36]、VA(Visual Attention)[37].各注意力机制在随机选择的6幅不同种类图像上进行可视化分析, 结果如图13所示, 图中前3幅图像来自大小为32× 32的CIFAR-10数据集, 后3幅图像来自大小为224× 224的Imagewoof数据集.由图可观察到图像分类网络提取不同种类图像的主要特征, 并通过不同种类动物或物品独有的特征进行识别, 蓝色一般表示低权重, 红色表示高权重.对于分类任务, 红色区域中的特征对网络预测起到关键作用, 而蓝色区域中的特征对网络预测的贡献度较低.由图13(b)、(c)清晰观察到, FCA和CA的热力图显示效果不佳, 由于它们采用轻量级的网络结构, 无法捕捉细微特征, 导致热力图中红色区域只覆盖部分的关键特征.相比FCA、CA和VA, CBAM能更好地捕捉与分类任务相关的关键特征, 红色区域能覆盖图像中的大部分特征, 但忽略微小的细节.TANet使用FDAM加强网络分类能力, 相比其它注意力机制, 能注意狗的细节特征, 并聚焦于关键特征, 减少其它环境因素的影响.

实验表明FDAM通过结合多尺度卷积特征提取与频域处理, 为多尺度特征提供更多的处理空间, 加强对图像细节的敏感度, 有效捕捉图像的高频细节和纹理信息, 显著提升图像的细节表示能力, 并通过不同尺度的特征融合及自适应加权融合机制, 在保证细节特征表达效果的同时, 减少对冗余信息的关注, 提高关键区域贡献度, 优化局部信息和全局信息的关注度, 增强关键特征的可利用性, 提高图像分类能力.

针对图像分类网络主要依赖空域特征, 忽视频域特征的作用, 从而导致性能提升受限的问题.本文提出面向图像分类的双域特征联合网络(TANet).TANet利用快速傅立叶变换, 设计频域特征提取模块(FDFE), 捕捉图像中的全局特征及高频细节信息, 增强图像细节信息的表示能力, 提高网络对图像特征的提取能力, 并将提取的频域特征转化为空域形式, 便于后续的特征联合.利用FDFE, 设计频域注意力机制模块(FDAM)和双域特征联合机制(TFAM).FDAM融合SKAttention与FDFE, 加强对图像细节的敏感度, 提高关键区域的贡献度, 平衡局部信息与全局信息的关注度, 增强重要特征的可利用性.TFAM在保证空域特征提取效果的同时, 利用频域特征补充图像的特征信息, 双域联合后的特征以空域形式呈现在网络中, 提高特征表示能力, 增强图像分类结果.

频域特征利用和特征融合在图像分类中潜力巨大, 未来的研究可聚焦于如何高效融合空域特征与频域特征, 优化融合机制, 减少计算开销, 增强网络对不同数据类型的适应能力, 进一步提升网络的分类性能.

本文责任编委 封举富

Recommended by Associate Editor FENG Jufu

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|

| [13] |

|

| [14] |

|

| [15] |

|

| [16] |

|

| [17] |

|

| [18] |

|

| [19] |

|

| [20] |

|

| [21] |

|

| [22] |

|

| [23] |

|

| [24] |

|

| [25] |

|

| [26] |

|

| [27] |

|

| [28] |

|

| [29] |

|

| [30] |

|

| [31] |

|

| [32] |

|

| [33] |

|

| [34] |

|

| [35] |

|

| [36] |

|

| [37] |

|